هوش مصنوعي چيست؟ هر آنچه بايد درباره تكنولوژي ChatGPT و Dall-E بدانيم

اينروزها همهجا صحبت از هوش مصنوعي يا AI است. اشكالات «حلنشدني» در حال حل شدن هستند؛ افرادي كه هيچ دانشي از كدنويسي يا آهنگسازي يا طراحي ندارند، به كمك AI و در عرض چند ثانيه وبسايت و آهنگ ميسازنند و طرحهاي هنري شگفتانگيز خلق ميكنند. شركتهاي بزرگ نيز درحال سرمايهگذاريهاي چند ميليارد دلاري در پروژههاي هوش مصنوعي هستند و مايكروسافت هم با آوردن چتبات ChatGPT به بينگ، در تلاش است مدل جستجوي ما در اينترنت را زيرورو كند و شايد حتي تا چند وقت ديگر، ساختار كل اينترنت را به هم بريزد.

سر در آوردن از هوش مصنوعي هم مثل هر تكنولوژي جديد ديگر كه با كلي هياهو و جنجال رسانهاي همراه است، ممكن است گيجكننده باشد و حتي متخصصان هوش مصنوعي هم بهسختي ميتوانند خود را با تحولات لحظهاي اين فناوري همراه كنند.

در زمينهي هوش مصنوعي، يك سري سوالات به مراتب پرسيده ميشود؛ مثلا اينكه دقيقا منظور از هوش مصنوعي چيست؟ فرق بين هوش مصنوعي، يادگيري ماشين و يادگيري عميق چيست؟ چه مسائل دشواري حالا بهراحتي قابل حل هستند و حل چه مسائلي هنوز از توانايي هوش مصنوعي خارج است؟ و شايد محبوبترين آنها؛ آيا قرار است دنيا با هوش مصنوعي نابود شود؟

اگر براي شما نيز سوال شده كه اين همه هياهو و هيجان بر سر هوش مصنوعي بهخاطر چيست و اگر دوست داريد پاسخ اين پرسشها را به زباني ساده ياد بگيريد، با ما همراه شويد تا نگاهي به پشت پردهي اين فناوري مرموز و قدرتمند بيندازيم.

- هوش مصنوعي چيست؟

- تاريخچه هوش مصنوعي

- انواع هوش مصنوعي

- يادگيري ماشين (Machine Learning)

- يادگيري عميق (Deep Learning)

- كاربرد هوش مصنوعي

- تشخيص اجسام (Object Recognition)

- تشخيص چهره (Face Recognition)

- تشخيص گفتار (Speech Recognition)

- ديپفيك و شبكههاي مولد (Deepfakes and Generative AI)

- نمونههاي هوش مصنوعي

- ChatGPT

- DALL-E

- Copilot

- Jukebox

- Midjourney

- New Bing

- LaMDA

- PaLM

- خطرات هوش مصنوعي

- آينده هوش مصنوعي

- آيا هوش مصنوعي بشر را نابود ميكند؟

هوش مصنوعي چيست؟

اصطلاح «هوش مصنوعي» (Artificial Intelligence) يا AI براي توصيف سيستمي بهكار ميرود كه ميتواند فعاليتهاي شناختي وابسته به ذهن انسان ازجمله «يادگيري» و «حل مسئله» را بهخوبي يا حتي بهتر از انسانها انجام دهد. اما در اكثر موارد، آنچه بهعنوان هوش مصنوعي ميشناسيم، درواقع «اتوماسيون» (Automation) يا همان فرايند خودكارسازي نام دارد و براي درك بهتر AI، ابتدا بايد فرق آن را با اتوماسيون بدانيم.

در دنياي علوم كامپيوتر يك جوك قديمي وجود دارد كه ميگويد اتوماسيون، كارهايي است كه ما همينحالا ميتوانيم با كامپيوتر انجام دهيم، اما هوش مصنوعي كارهايي است كه ما دلمان ميخواست ميتوانستيم با كامپيوتر انجام دهيم. بهعبارت ديگر، بهمحض اينكه بفهميم چطور كاري را با كامپيوتر انجام دهيم، از حوزهي هوش مصنوعي خارج و وارد اتوماسيون ميشويم.

دليل وجود اين جوك اين است كه هوش مصنوعي تعريف دقيقي ندارد و حتي اصطلاح متخصص نيست. اگر به ويكيپديا نگاهي بيندازيد، ميخوانيد كه هوش مصنوعي «هوشي است كه توسط ماشينها ظهور پيدا ميكند، در مقابل هوش طبيعي كه توسط جانوران شامل انسانها نمايش مييابد.» يعني تعريفي به همين مبهمي و گستردگي.

بهطور كلي، دو نوع هوش مصنوعي وجود دارد: هوش مصنوعي قوي (strong AI) و هوش مصنوعي ضعيف (weak AI).

هوش مصنوعي قوي هماني است كه اكثر افراد با شنيدن AI متصور ميشوند؛ يعني نوعي هوش داناي كل شبيه شخصيت هال ۹۰۰۰، همان ربات قاتلِ فيلم اديسهي فضايي يا سيستم خودآگاه هوش مصنوعي اسكاينت در فيلمهاي تريميناتور كه در عين داشتن هوش فراانساني و قابليت استدلال و تفكر منطقي، تواناييهايي فراتر از انسانها نيز دارند.

آنچه از هوش مصنوعي تابهحال ديدهايم از نوع هوش مصنوعي ضعيف است

درمقابل، هوش مصنوعي ضعيف الگوريتمهاي بسيار تخصصياي هستند كه براي پاسخ به سوالات مشخص، مفيد و محدود به حيطهي همان مسئله طراحي شدهاند؛ مثل موتور جستجوي گوگل و بينگ، الگوريتم پيشنهاد فيلم نتفليكس يا حتي دستيار صوتي Siri و گوگلاسيستنت. اين مدل AIها در سطح خود بسيار قابلتوجه هستند، هرچند كارايي آنها محدود است.

اما فيلمهاي علميتخيلي هاليوودي را كه كنار بگذاريم، هنوز با دستيابي به هوش مصنوعي قوي فاصلهي زيادي داريم. درحالحاضر، تمام AIهايي كه ميشناسيم از نوع ضعيف هستند و برخي از پژوهشگران معتقدند روشهايي كه تابهحال براي توسعهي هوش مصنوعي ضعيف به كار رفتهاند، متخصصدي در توسعهي هوش مصنوعي قوي نخواهند داشت. البته اگر انديشه متخصصين متخصصان شركت OpenAI، توسعهدهندهي چتبات محبوب ChatGPT را بپرسيد، به شما خواهند گفت تا ۱۳ سال آينده و با همين روشهاي شناختهشده ميتوانند به هوش مصنوعي قوي دست پيدا كنند!

اگر بخواهيم در اين موضوع خيلي دقيق شويم، بايد بگوييم كه «هوش مصنوعي» درحالحاضر بيشتر اصطلاحي براي جلبتوجه و بازاريابي است تا اصطلاحي متخصص. دليل اينكه شركتها به جاي استفاده از واژهي «اتوماسيون» از هوش مصنوعي استفاده ميكنند اين است كه ميخواهند در ذهن ما همان تصاوير علميتخيلي فيلمهاي هاليوودي را تداعي كنند. اما اين كار كاملا هم زرنگبازي و فريبكاري نيست؛ اگر بخواهيم دستودلبازي به خرج دهيم، ميتوان گفت اين شركتها قصد دارند بگويند درست است كه تا رسيدن به هوش مصنوعي قوي راه درازي در پيش داريم، اما AI ضعيف كنوني را هم نبايد دستكم گرفت، چون بهمراتب از چند سال پيش، قويتر شده است كه خب، اين حرف كاملاً درست است.

در برخي زمينهها، تغييرات شگرفي در توانايي ماشينها صورت گرفته و آن هم بهخاطر پيشرفتهايي است كه در چند سال اخير، در دو زمينهي مرتبط با هوش مصنوعي، يعني يادگيري ماشين (Machine Learning) و يادگيري عميق (Deep Learning) بهدست آمده است. اين دو اصطلاح را هم احتمالا بسيار شنيدهايد و در ادامه دربارهي سازوكارشان توضيح خواهيم داد. اما پيش از آن، اجازه دهيد كمي دربارهي تاريخچهي جالب و خواندني هوش مصنوعي با شما صحبت كنيم.

تاريخچه هوش مصنوعي

آيا ماشينها ميتوانند فكر كنند؟

در نيمهي اول قرن بيستم، داستانهاي علميتخيلي، مردم را با مفهوم رباتهاي هوشمند آشنا كردند كه اولين آنها، شخصيت مرد حلبي در رمان «جادوگر شهر اُز» (۱۹۰۰) بود. تا اينكه در دههي ۱۹۵۰، نسلي از دانشمندان، رياضيدانان و فيلسوفاني را داشتيم كه ذهنشان با مفهوم هوش مصنوعي درگير شد. يكي از اين افراد، رياضيدان و دانشمند كامپيوتر انگليسي بهنام آلن تورينگ (Alan Turing) بود كه سعي داشت امكان دستيابي به هوش مصنوعي را با علم رياضي مطالعه كند.

تورينگ ميگفت انسانها از اطلاعات موجود و همچنين قدرت استدلال براي تصميمگيري و حل اشكالات استفاده ميكنند، پس چرا ماشينها نميتوانند همين كار را انجام دهند؟ اين دغدغهي ذهني درنهايت به نوشتن مقالهي بسيار معروفي در سال ۱۹۵۰ انجاميد كه با پرسش جنجالي «آيا ماشينها ميتوانند فكر كنند؟» شروع ميشد. تورينگ در اين مقاله به شرح چگونگي ساخت ماشينهاي هوشمند و آزمايش سطح هوشمندي آنها پرداخت و با پرسش «آيا ماشينها ميتوانند از بازي تقليد سربلند بيرون آيند؟»، آغازگر آزمون بسيار معروف «تست تورينگ» شد.

نبود حافظه و هزينههاي سرسامآور كامپيوترها، تورينگ را از تست انديشه متخصصينيهاش بازداشت

اما مقالهي تورينگ تا چند سال در حد انديشه متخصصينيه باقي ماند، چراكه آن زمان كامپيوترها از پيشنياز كليدي براي هوشمندي، بيبهره بودند؛ اينكه نميتوانستند دستورات را ذخيره كنند و فقط ميتوانستند آنها را اجرا كنند. بهعبارت ديگر، ميشد به كامپيوترها گفت چه كنند، اما نميشد از آنها خواست كاري را كه انجام دادهاند، بهخاطر بياورند.

اشكال بزرگ دوم، هزينههاي سرسامآور كار با كامپيوتر بود. اوايل دههي ۱۹۵۰، هزينهي اجارهي كامپيوتر تا ۲۰۰ هزار دلار در ماه ميرسيد؛ بههمينخاطر، فقط دانشگاههاي معتبر و شركتهاي بزرگ فناوري ميتوانستند به اين حوزه وارد شوند. اگر آنروزها كسي ميخواست براي پژوهشهاي هوش مصنوعي، فاند دريافت كند، لازم بود كه ابتدا ممكن بودن ايدهي خود را اثبات ميكرد و بعد، از حمايت و تأييد افراد بانفوذ بهرهمند ميشد.

كنفرانس تاريخي DSRPAI كه همهچيز با آن شروع شد

پنج سال بعد، سه پژوهشگر علوم كامپيوتر بهنامهاي الن نيوول، كليف شا و هربرت سايمون نرمافزار Logic Theorist را توسعه دادند كه توانست ممكن بودن ايدهي هوش ماشيني تورينگ را اثبات كند. اين برنامه كه با بودجهي شركت تحقيق و توسعهي RAND توسعه داده شده بود، بهگونهاي طراحي شده بود تا مهارتهاي حل مسئلهي انسان را تقليد كند.

اصطلاح «هوش مصنوعي» توسط جان مككارتي در سال ۱۹۵۶ ابداع شد

بسياري، Logic Theorist را اولين برنامهي هوش مصنوعي ميدانند. اين برنامه در پروژهي تحقيقاتي تابستاني كالج دارتموث در زمينهي هوش مصنوعي (DSRPAI) به ميزباني جان مككارتي (John McCarthy) و ماروين مينسكي (Marvin Minsky) در سال ۱۹۵۶ ارائه شد.

در اين كنفرانس تاريخي، مككارتي پژوهشگران برتر در حوزههاي مختلف را براي مباحثه آزاد در مورد هوش مصنوعي(اصطلاحي كه خود مككارتي در همان رويداد ابداع كرد)، دور هم جمع كرد، با اين تصور كه با همكاري جمعي دستيابي به هوش مصنوعي ممكن ميشد. اما كنفرانس نتوانست انتظارات مككارتي را برآورده كند، چراكه هيچ هماهنگي بين پژوهشگران نبود؛ آنها به دلخواه خود ميآمدند و ميرفتند و در مورد روشهاي استاندارد براي انجام پژوهشهاي هوش مصنوعي به هيچ توافقي نرسيدند. بااينحال، تمام شركتكنندگان از صميم قلب اين حس را داشتند كه هوش مصنوعي قابل دستيابي است.

اهميت كنفرانس DSRPAI غيرقابلوصف است؛ چراكه ۲۰ سال پژوهش حوزهي هوش مصنوعي برمبناي آن صورت گرفت.

ترن هوايي موفقيتها و شكستهاي هوش مصنوعي

از سالهاي ۱۹۵۷ تا ۱۹۷۴، بهعنوان دوران شكوفايي هوش مصنوعي ياد ميشود. در اين دوره، كامپيوترها سريعتر، ارزانتر و فراگيرتر شدند و ميتوانستند اطلاعات بيشتري را ذخيره كنند. الگوريتمهاي يادگيري ماشين نيز بهبود يافتند و افراد، بهتر ميدانستند كدام الگوريتم را براي حل كدام اشكال به كار برند.

نمونه برنامههاي كامپيوتري اوليه مانند General Problem Solver نيوول و سايمون يا نرمافزار ELIZA كه سال ۱۹۶۶ توسط جوزف وايزنبام طراحي شده و اولين چتباتي بود كه توانست آزمون تورينگ را با موفقيت پشت سر بگذارد، بهترتيب، دانشمندان را چند قدم به اهداف «حل مسئله» و «تفسير زبان گفتاري» نزديكتر كرد.

در اين زمان پژوهشگران به آينده هوش مصنوعي بسيار خوشبين بودند

اين موفقيتها همراهبا حمايت پژوهشگران برجستهاي كه در كنفرانس DSRPAI شركت كرده بودند، سرانجام سازمانهاي دولتي مانند آژانس پروژههاي تحقيقاتي پيشرفته دفاعي آمريكا (دارپا) را متقاعد كرد تا بودجهي لازم براي پژوهشهاي هوش مصنوعي را در چندين موسسه تأمين كنند. دولت آمريكا بهويژه به توسعهي ماشيني علاقهمند بود كه بتواند هم زبان گفتاري و هم پردازش دادهها را با توان عملياتي بالا رونويسي و ترجمه كند.

در اين زمان، پژوهشگران به آيندهي اين حوزه بسيار خوشبين بودند و سطح توقعاتشان حتي از ميزان خوشبينيشان هم بالاتر بود؛ بهطوري كه در سال ۱۹۷۰، ماروين مينسكي به مجله لايف گفت: «سه تا هشت سال آينده، ما به ماشيني با هوش عمومي يك انسان عادي دست خواهيم يافت.» با اين حال، اگرچه امكان رسيدن به هوش مصنوعي براي همه اثبات شده بود، هنوز راه بسيار درازي تا دستيابي به اهداف نهايي پردازش زبان طبيعي، تفكر انتزاعي و خويشتنآگاهي در ماشينها باقي مانده بود.

موانع زيادي سر راه تحقق اين اهداف قرار داشت كه بزرگترينشان، نبود قدرت رايانشي كافي براي انجام پروژهها بود. كامپيوترهاي آن زمان نه جاي كافي براي ذخيرهي حجم عظيمي از اطلاعات داشتند و نه سرعت لازم براي پردازش آنها. هانس موراوك، دانشجوي دكتراي مككارتي در آن زمان، گفت كه «كامپيوترها آن موقع ميليونها بار ضعيفتر از آن بودند كه بتوانند هوشي از خود نشان دهند». وقتي كاسهي صبر پژوهشگران لبريز شد، بودجههاي دولتي نيز كاهش يافت و تا ده سال، سرعت پژوهشهاي هوش مصنوعي بهشدت كند شد.

تا اينكه در دههي ۱۹۸۰، دو عامل جان دوبارهاي به پژوهشهاي هوش مصنوعي بخشيدند؛ بهبود چشمگير در الگوريتمها و از راه رسيدن بودجههاي جديد.

بهبود چشمگير در الگوريتمها جان دوبارهاي به پژوهشهاي هوش مصنوعي بخشيد

جان هاپفيلد (John Hopfield) و ديويد روملهارت (David Rumelhart) تكنيكهاي «يادگيري عميق» (Deep Learning) را گسترش دادند كه به كامپيوترها اجازه ميداد خودشان با تجربه كردن، چيزهاي جديد ياد بگيرند. از آن طرف هم، دانشمند آمريكايي علوم كامپيوتر، ادوارد فاينباوم (Edward Feigenbaum)، «سيستمهاي خبره» (Expert Systems) را معرفي كرد كه فرايند تصميمگيري افراد متخصص را تقليد ميكردند. اين سيستم از افراد خبره در زمينههاي مختلف ميپرسيد كه در موقعيتي خاص، چه واكنشي نشان ميدهند و بعد پاسخهاي آنها را در اختيار افراد غيرمتخصص قرار ميداد تا آنها از برنامه ياد بگيرند.

از سيستمهاي خبره بهطور گسترده در صنايع استفاده شد. دولت ژاپن بهعنوان بخشي از پروژهي نسل پنجم كامپيوتر (FGCP)، سرمايهگذاري كلاني در سيستمهاي خبره و ديگر پروژههاي هوش مصنوعي انجام داد. از سال ۱۹۸۲ تا ۱۹۹۰، ژاپن ۴۰۰ ميليون دلار براي ايجاد تحول در پردازشهاي كامپيوتري، اجراي برنامهنويسي منطقي و بهبود هوش مصنوعي هزينه كرد.

متاسفانه، اكثر اين اهداف بلندپروازانه محقق نشد؛ اما ميتوان اين طور به قضيه نگاه كرد كه پروژهي FGCP ژاپن بهطور غيرمستقيم الهامبخش نسلي از مهندسان و دانشمندان جوان شد تا به دنياي هوش مصنوعي قدم بگذارند. درنهايت، بودجهي FGCP هم روزي به سر رسيد و هوش مصنوعي بار ديگر از كانون توجه خارج شد.

شكست قهرمان شطرنج دنيا دربرابر ديپبلو؛ اولين گام بزرگ به سمت توسعه AI با قابليت تصميمگيري

از قضا، هوش مصنوعي در نبود بودجهي دولتي و هياهوي تبليغاتي، فرصت ديگري براي رشد پيدا كرد. در طول دهههاي ۱۹۹۰ و ۲۰۰۰، بسياري از اهداف مهم هوش مصنوعي محقق شد. در سال ۱۹۹۷، ابركامپيوتر شطرنجبازي به نام ديپ بلو (Deep Blue) ساخته شركت IBM توانست گري كاسپارف، استاد بزرگ و قهرمان شطرنج جهان را شكست دهد. در اين مسابقه كه با هياهوي رسانهاي بزرگي همراه بود، براي نخستين بار در تاريخ، قهرمان شطرنج جهان در برابر كامپيوتر شكست خورد و از آن بهعنوان اولين گام بزرگ بهسوي توسعهي برنامهي هوش مصنوعي با قابليت تصميمگيري ياد ميشود.

در همان سال، نرمافزار تشخيص گفتار شركت Dragon System روي ويندوز پيادهسازي شد. اين هم گام بزرگ ديگري در حوزهي هوش مصنوعي، اما در جهت اهداف تفسير زبان گفتاري بود. اينطور به انديشه متخصصين ميرسيد كه ديگر مسئلهاي وجود ندارد كه ماشينها نتوانند از پس آن برآيند. حتي پاي احساسات انساني هم به ماشينها باز شد؛ ربات كيزمت (Kismet) كه در دههي ۱۹۹۰ توسط سينتيا بريزيل (Cynthia Breazeal) در دانشگاه MIT ساخته شد، ميتوانست احساسات را درك و حتي آنها را به نمايش بگذارد.

زمان؛ مرهم تمام زخمها

دانشمندان هنوز از همان روشهاي چند دههي پيش براي برنامهنويسي هوش مصنوعي استفاده مي كنند؛ اما چه شد كه حالا به دستاوردهاي چشمگيري مثل چتبات ChatGPT و مولد تصوير Dall-E و Midjourney رسيديم؟

پاسخ اين است كه مهندسان سرانجام موفق شدند اشكال محدوديت ذخيرهسازي كامپيوترها را حل كنند. قانون مور (Moore’s Law) كه تخمين ميزند حافظه و سرعت كامپيوترها هر سال دوبرابر ميشود، بالاخره توانست به وقوع بپيوندد و حتي در بسياري از موارد، از اين حد هم فراتر برود. درواقع، دليل شكست گري كاسپارف در سال ۱۹۹۷ و شكست قهرمان بازي تختهاي گو، كه جي (Ke Jie) در سال ۲۰۱۷ دربرابر برنامهي AlphaGo گوگل به همين افزايش سرعت و حافظهي كامپيوترها برميگردد. اين قضيه، روند پژوهشهاي هوش مصنوعي را كمي توضيح ميدهد؛ اينكه ما قابليتهاي هوش مصنوعي را تا سطح قدرت محاسباتي فعلي (از انديشه متخصصين سرعت پردازش و حافظهي ذخيريسازي) توسعه ميدهيم و بعد منتظر ميمانيم تا قانون مور دوباره به ما برسد.

دليل شكست انسانها از هوش مصنوعي؛ افزايش سرعت و حافظه كامپيوترها

ما اكنون در عصر «كلانداده» زندگي ميكنيم؛ عصري كه در آن توانايي جمعآوري حجم عظيمي از اطلاعات را داريم كه پردازش تمام آنها توسط انسانها بينهايت دشوار و وقتگير است. استفاده از هوش مصنوعي در صنايع مختلفي ازجمله تكنولوژي، بانكداري، ماركتينگ و سرگرمي، اين دشواري را تاحدود زيادي حل كرده است. مدلهاي زباني بزرگ كه در چتبات ChatGPT به كار رفتهاند، به ما نشان دادند كه حتي اگر الگوريتمها پيشرفت چنداني نداشته باشند، كلانداده و محاسبات عظيم ميتوانند به هوش مصنوعي كمك كنند كه خودش ياد بگيرد و عملكردش را بهتر كند.

شايد شواهدي وجود داشته باشد كه نشان ميدهد سرعت قانون مور، بهويژه در دنياي تراشهها، كند شده است، اما افزايش حجم اطلاعات با سرعت سرسامآوري در حال پيشروي است. پيشرفتهايي كه در علوم كامپيوتر، رياضيات يا علوم اعصاب به دست ميآيند همگي ميتوانند بشر را از تنگاي محدوديت قانون مور عبور دهند. و اين يعني، پيشرفت بشر در تكنولوژي هوش مصنوعي به اين زوديها به پايان نخواهد رسيد.

انواع هوش مصنوعي

هوش مصنوعي به روشهاي مختلفي دستهبندي ميشود؛ جدا از دستهبندي بسيار كلي هوش مصنوعي ضعيف و هوش مصنوعي قوي كه در ابتداي مقاله دربارهاش صحبت كرديم، روش رايج ديگري هوش مصنوعي را به چهار دسته تقسيم ميكند:

۱) ماشينهاي واكنشي (Reactive Machines) كه سادهترين نوع هوش مصنوعي هستند و تنها ميتوانند به موقعيتهاي فعلي بدون استفاده از تجربيات گذشته پاسخ دهند؛ مثل موتورجستجوي گوگل.

۲) ماشينهاي حافظه محدود (Limited Memory) كه ميتوانند از برخي دادههاي گذشته براي بهبود تصميمگيري استفاده كنند؛ مثل سيستم احراز هويت در وبسايتها.

۳) انديشه متخصصينيه ذهن (Theory of Mind) كه درحالحاضر نوع فرضي هوش مصنوعي است كه ميتواند به شكل بهتري احساسات، عواطف و اعتقادات انسانها را درك و سپس از اين اطلاعات براي تصميمگيري خود استفاده كند.

۴) هوش مصنوعي خودآگاه (Self-aware) كه آن هم يكي ديگر از انواع فرضي هوش مصنوعي است كه به خودآگاهي رسيده و ميتواند از خودش احساسات و افكار شبيه انسانها داشته باشد.

اما متخصصديترين دستهبندي هوش مصنوعي كه كاري به فرضيهها و انديشه متخصصينيات ندارد و صرفا آنچه تاكنون به دست آمده را تشريح ميكند، «يادگيري ماشين» (Machine learning) و «يادگيري عميق» (Deep learning) است كه نوعي از آنها تقريبا در تمام سيستمهاي هوش مصنوعي امروزي به كار رفته است.

اگر مدتها برايتان سوال بوده كه اين دو اصطلاح دقيقا به چه معني هستند، اما هنوز جواب اين سوال را بهطور دقيق نميدانيد، نگران نباشيد؛ ما اينجا تلاش خواهيم كرد به سادهترين شكل ممكن، اين دو ممباحثه بسيار پيچيده را توضيح دهيم.

يادگيري ماشين (Machine Learning)

يادگيري ماشين روش خاصي براي ايجاد هوش مصنوعي است. فرض كنيد ميخواهيم موشكي را پرتاب و محل فرود آن را پيشبيني كنيم. اين كار البته آنقدرها سخت نيست؛ گرانش ممباحثه جاافتادهاي است و ميتوان معادلات مربوط را نوشت و حساب كرد براساس چند متغير از جمله سرعت و موقعيت، موشك فرضي كجا فرود خواهد آمد.

اما وقتي پاي متغيرهاي ناشناخته وسط ميآيد، ديگر نميتوان به اين راحتي جواب سوال را پيدا كرد. اين بار فرض كنيد ميخواهيم كامپيوتر به تعدادي تصوير نگاه كند و بگويد آيا در بين آنها تصويري از گربه بوده است يا خير. براي اين سوال چه نوع معادلهاي ميتوانيم بنويسيم كه تمام تركيبهاي ممكن سبيل و گوش گربه از زواياي مختلف را براي كامپيوتر توصيف كند؟

اينجا است كه يادگيري ماشين به كمك دانشمندان ميآيد؛ به جاي اينكه خودمان فرمول و قوانين را بنويسيم، سيستمي ميسازيم كه بتواند قوانين را با مشاهدهي چندين نمونه عكس، براي خودش بنويسد. بهعبارتديگر، به جاي اينكه بخواهيم گربه را توصيف كنيم، به هوش مصنوعي تعداد زيادي تصوير گربه نشان دهيم و اجازه ميدهيم خودش متوجه شود چه چيزي گربه است و چه چيزي گربه نيست.

يادگيري ماشين براي دنياي كنوني لبريز از دادهي ما فوقالعاده است، چرا كه سيستمي كه بتواند قوانين خودش را براساس داده ياد بگيرد، ميتواند با دادههاي بيشتر بهبود يابد. ميخواهيد سيستمتان در تشخيص گربه ماهرتر شود؟ خب اينترنت در همين لحظه دارد ميليونها تصوير گربه توليد ميكند!

يكي از دلايلي كه يادگيري ماشين در چند سال اخير تا اين اندازه محبوب شده، همين افزايش چشمگير حجم داده در اينترنت است؛ دليل ديگر به نحوهي استفاده از اين دادهها مربوط ميشود. در مباحثه يادگيري ماشين، به جز داده، دو سوال مرتبط ديگر نيز مطرح ميشود:

۱) چطور چيزي را كه ياد گرفتم، به خاطر بسپارم؟ در كامپيوتر چطور قوانين و روابطي را كه از نمونه داده استخراج كردهام، ذخيره كنم و نمايش دهم؟

۲) چطور فرايند يادگيري را انجام دهم؟ چطور قوانين و روابطي را كه در پاسخ به نمونههاي قبلي ذخيره كردهام، براي نمونههاي جديد تغيير داده و بهتر شوم؟

بهعبارت ديگر، چيزي كه دارد از اين همه داده، ياد ميگيرد دقيقا چيست؟

در يادگيري ماشين انتخاب نوع مدل بسيار مهم است

در يادگيري ماشين، به نمايش كامپيوتري چيزهاي ياد گرفته شده و ذخيره شده، «مدل» ميگويند. اينكه از چه مدلي استفاده كنيد، بسيار مهم است، چون اين مدل است كه روش يادگيري هوش مصنوعي، نوع دادههايي كه ميتواند از آن بياموزد و نوع سوالهايي را كه ميتوان از آن پرسيد، مشخص ميكند.

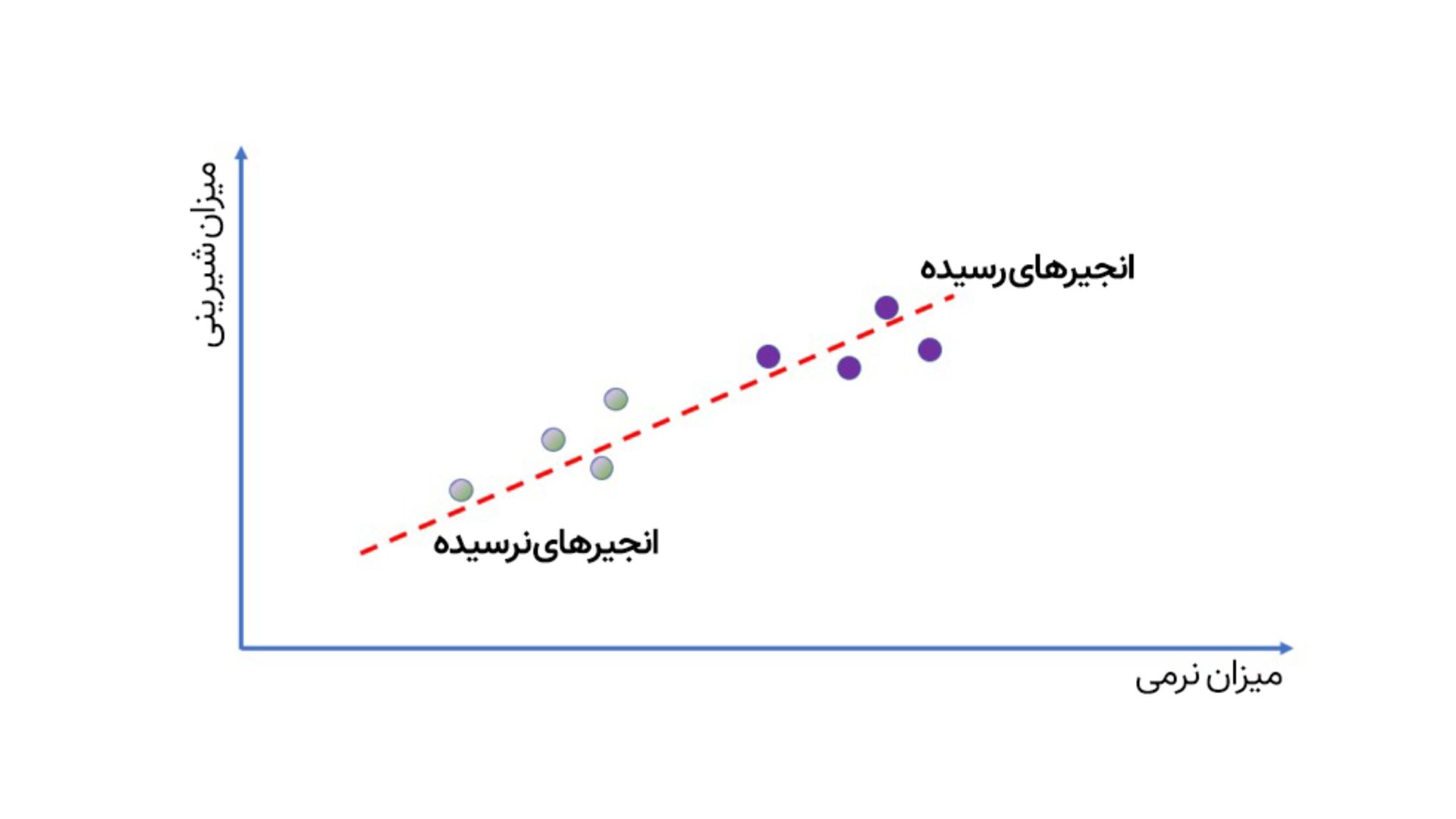

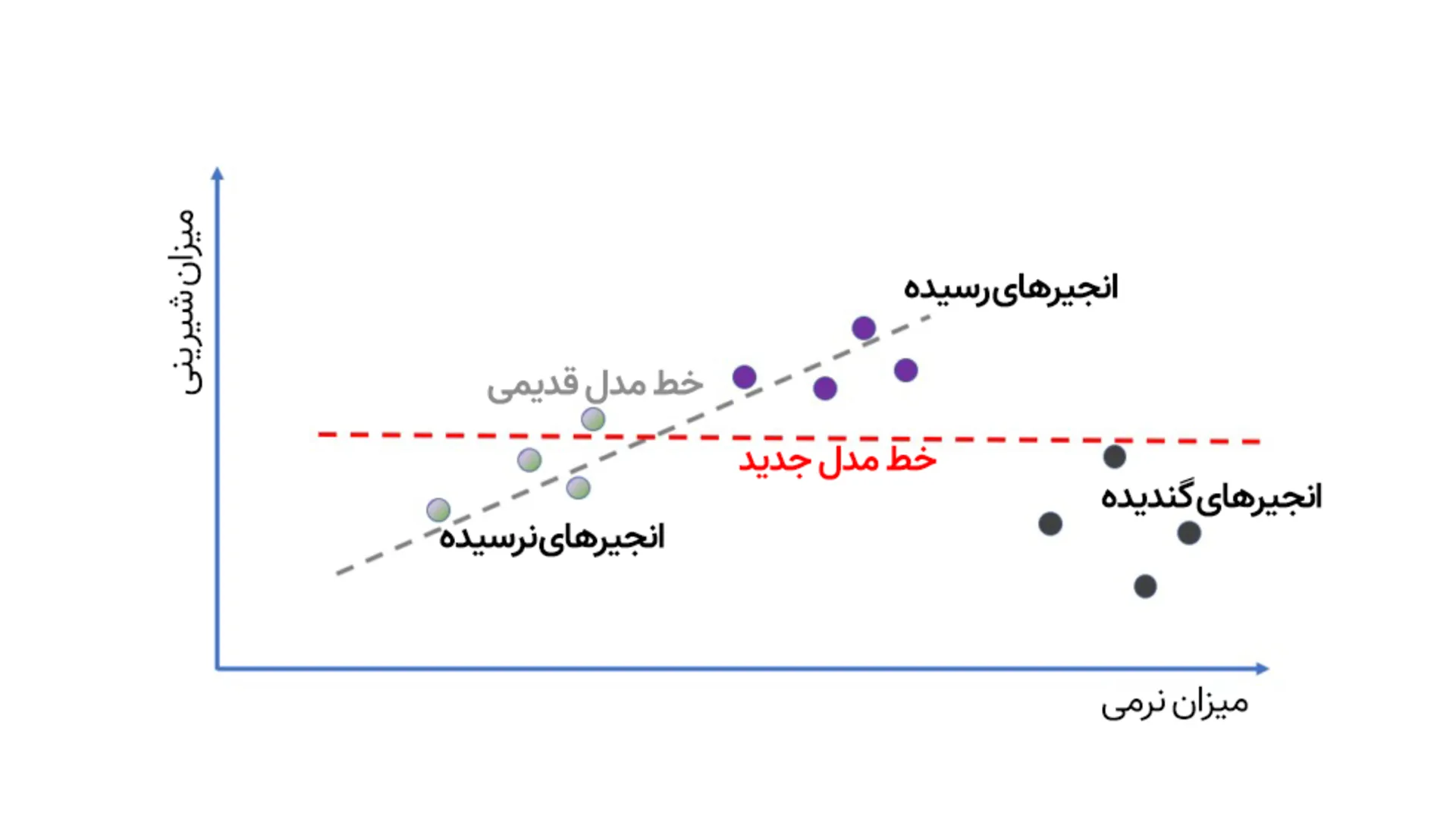

بياييد اين موضوع را با يك مثال ساده روشنتر كنيم. فرض كنيد براي خريد انجير به ميوهفروشي رفتهايم و ميخواهيم بهكمك يادگيري ماشين بفهميم كدام انجيرها رسيدهاند. كار آساني بايد باشد، چون ميدانيم هرچه انجير نرمتر باشد، رسيدهتر و شيرينتر خواهد بود. ميتوانيم چند نمونه انجير رسيده و كال را انتخاب كرده، ميزان شيريني آنها را مشخص كنيم و بعد اطلاعاتشان را روي نمودار خطي قرار دهيم. اين خط همان «مدل» ما است. اگر دقت كنيد، همين خط ساده، ايدهي «هرچه نرمتر باشد، شيرينتر است» را بدون اينكه لازم باشد ما چيزي بنويسيم، نشان ميدهد. هوش مصنوعي نوپاي ما هنوز چيزي درباره ميزان قند يا چگونگي رسيده شدن ميوهها نميداند، اما ميتواند ميزان شيريني آنها را با فشار دادن و اندازهگيري نرمي پيشبيني كند.

همانطور كه در تصوير سمت راست ميبينيد، هوش مصنوعي سادهي ما بدون اينكه چيزي دربارهي ميزان شيريني بداند يا اينكه ميوهها چطور رسيده ميشوند، ميتواند پيشبيني كند كه با فشردن ميوه و تشخيص نرمي آن، چقدر شيرين است.

براي بهبود مدل، ميتوان نمونههاي بيشتري جمعآوري كرد و خط ديگري را براي پيشبيني دقيقتر كشيد(مانند تصوير سمت چپ).

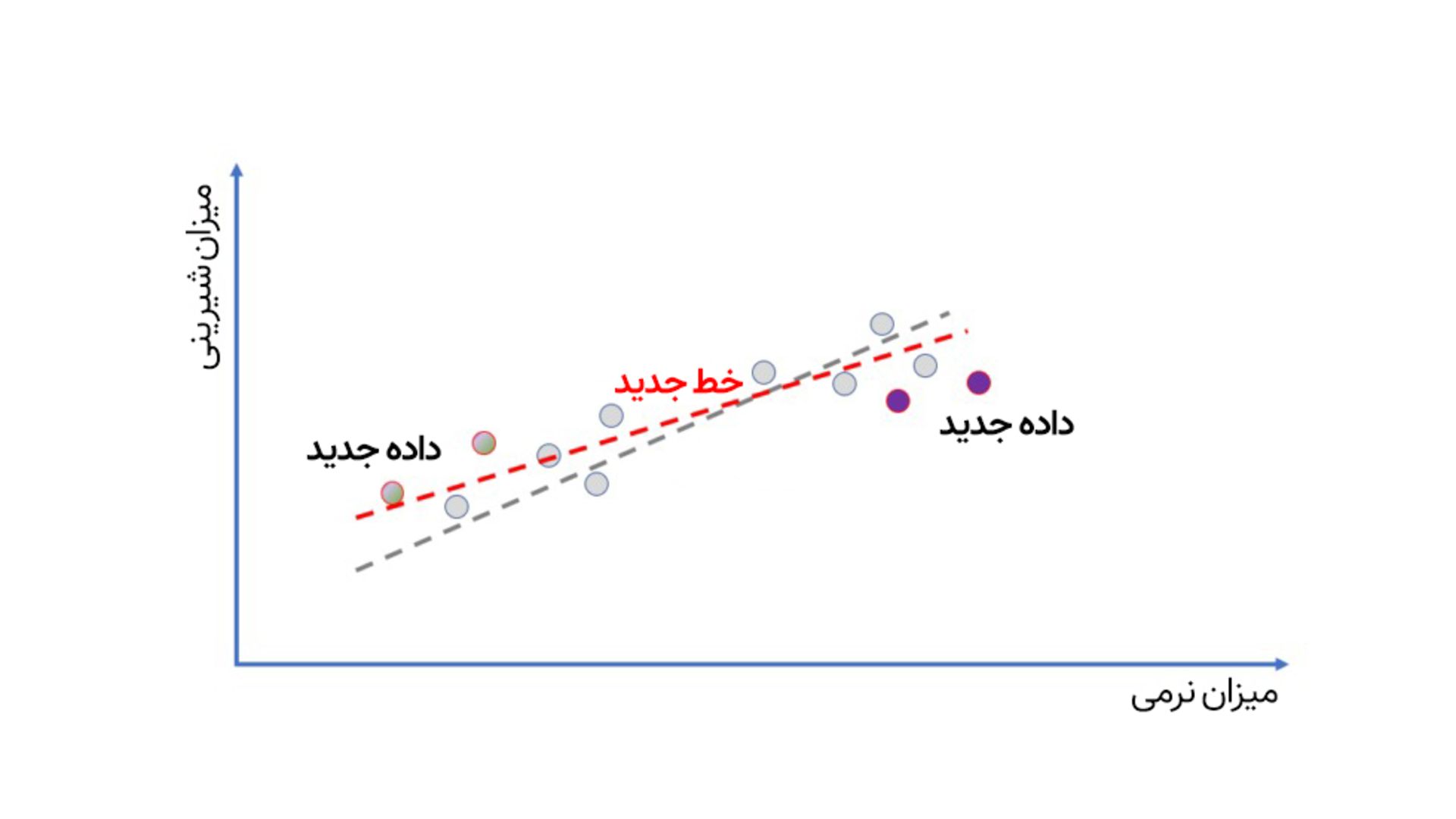

اما اشكالات بلافاصله خودشان را نشان ميدهند. ما تا اينجا داشتيم AI انجيرمان را براساس انجيرهاي دستچين مغازه يادگيري ميداديم؛ اگر بخواهيم آن را وسط باغ انجير ببريم چه؟ حالا علاوهبر انجيرهاي تازه، انجيرهاي گنديده هم خواهيم داشت كه بااينكه نرم هستند، اما نميتوان آنها را خورد.

چه كار ميشود كرد؟ خب اين يك مدلِ يادگيري ماشين است، پس ميتوان با اضافه كردن دادههاي جديد درباره انجيرهاي گنديده، آن را بهتر كرد، مگرنه؟

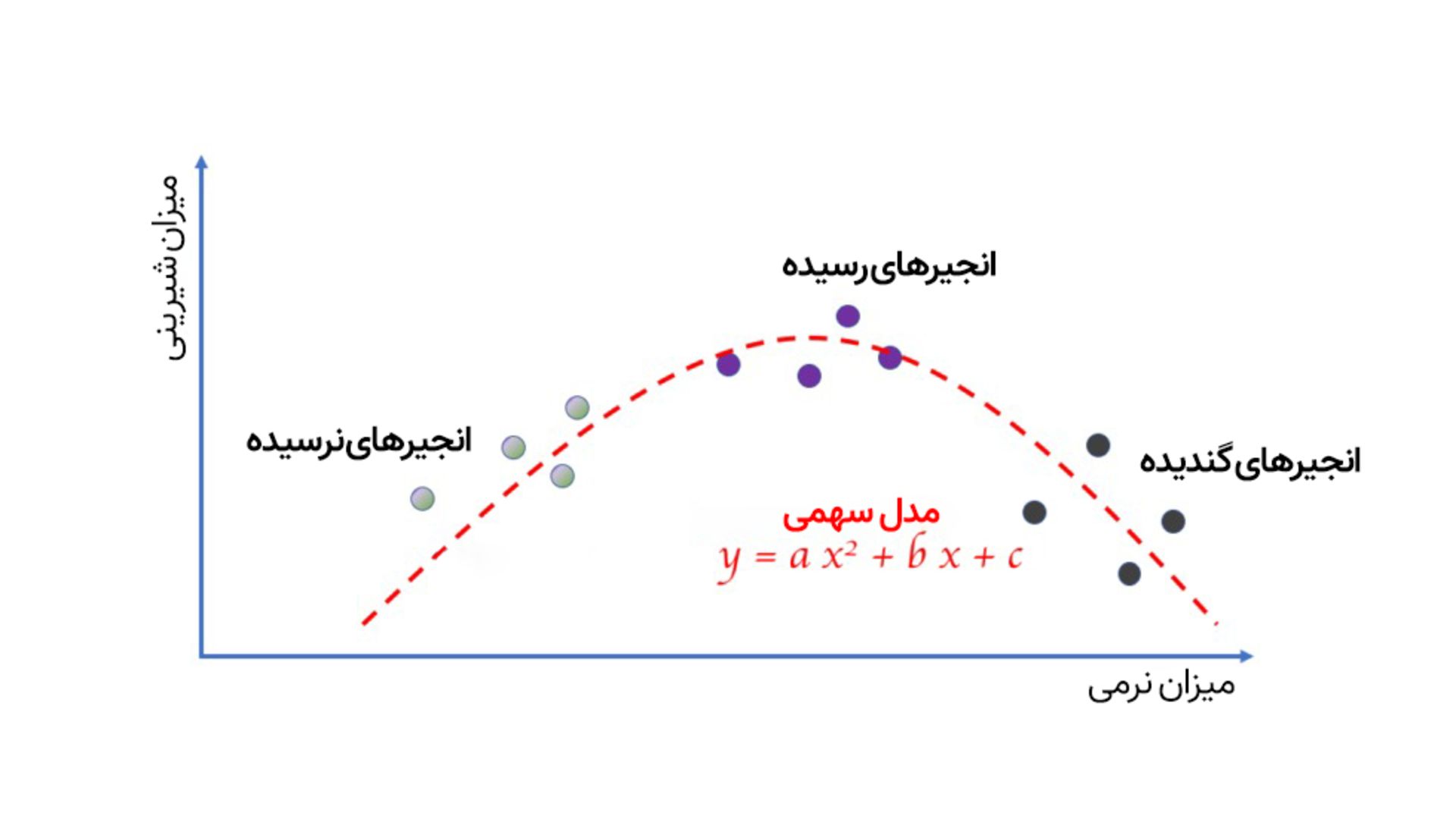

راستش داستان به اين سادگيها نيست. همانطور كه در تصوير زير ميبينيد، با اضافه كردن دادههاي مربوط به انجيرهاي گنديده، كل نمودار خطي به هم ميريزد و اين يعني ما بايد سراغ مدل ديگري، مثلا نمودار سهمي برويم.

البته اين مثال مسخرهاي است، اما به خوبي نشان ميدهد نوع مدلي كه براي يادگيري ماشين انتخاب ميكنيم، نوع و محدوديت يادگيري آن را تعيين ميكند. بهعبارت سادهتر، اگر ميخواهيد چيز پيچيدهتري را ياد بگيريد، بايد سراغ مدلهاي پيچيدهتري برويد.

چالش اصلي يادگيري ماشين، ايجاد و انتخاب مدل مناسب براي حل مسئله است

با اين حساب، چالش اصلي يادگيري ماشين، ايجاد و انتخاب مدل مناسب براي حل مسئله است. ما به مدلي نياز داريم كه بهقدري پيچيده باشد كه بتواند روابط و ساختارهاي بسيار پيچيده را نشان دهد و در عين حال به قدري ساده باشد كه بتوانيم با آن كار كنيم و يادگيريش بدهيم. براي همين، اگرچه اينترنت، موبايلهاي هوشمند و چيزهايي از اين دست، دسترسي به حجم عظيمي از داده را ممكن كردهاند، ما هنوز براي استفاده از اين دادهها بايد سراغ مدلهاي مناسب برويم.

و اين دقيقا جايي است كه ما به نوع ديگر هوش مصنوعي، يعني يادگيري عميق نياز پيدا ميكنيم.

يادگيري عميق (Deep Learning)

يادگيري عميق نوعي يادگيري ماشين است كه از يك نوع خاصي از مدل به نام «شبكههاي عصبي عميق» (Deep Neural Networks) استفاده ميكند.

شبكههاي عصبي نوعي مدل يادگيري ماشين هستند كه از ساختاري مشابه نورونهاي مغز انسان براي انجام محاسبات و پيشبيني استفاده ميكنند. نورونها در شبكههاي عصبي در لايههاي مختلف طبقهبندي ميشوند و هر لايه يك سري محاسبات ساده انجام ميدهد و پاسخ آن را به لايهي بعدي منتقل ميكند. هر چه تعداد لايهها بيشتر باشد، ميتوان محاسبات پيچيدهتري انجام داد.

شبكههاي عصبي عميق بهخاطر تعداد زياد لايههاي نوروني «عميق» ناميده ميشوند

مثلا براي مثال انجيرها، يك شبكهي ساده با چند لايه نورون كافي است تا جواب مسئله را پيشبيني كند. اما شبكههاي عصبي عميق دهها يا حتي صدها لايه دارند و دقيقا به همين دليل به آنها عميق ميگويند. با اين همه لايه ميتوانيد مدلهاي بينهايت قدرتمندي بسازيد كه قادرند بينياز از قوانين تعيينشده توسط انسانها، انواع و اقسام مفاهيم پيچيده را خودشان ياد بگيرند و از پس مسائلي كه كامپيوترها قبلا از حل آنها عاجز بودند، برآيند.

اما به جز تعداد لايه، عامل ديگري نيز باعث موفقيت شبكههاي عصبي شده و آن يادگيري است.

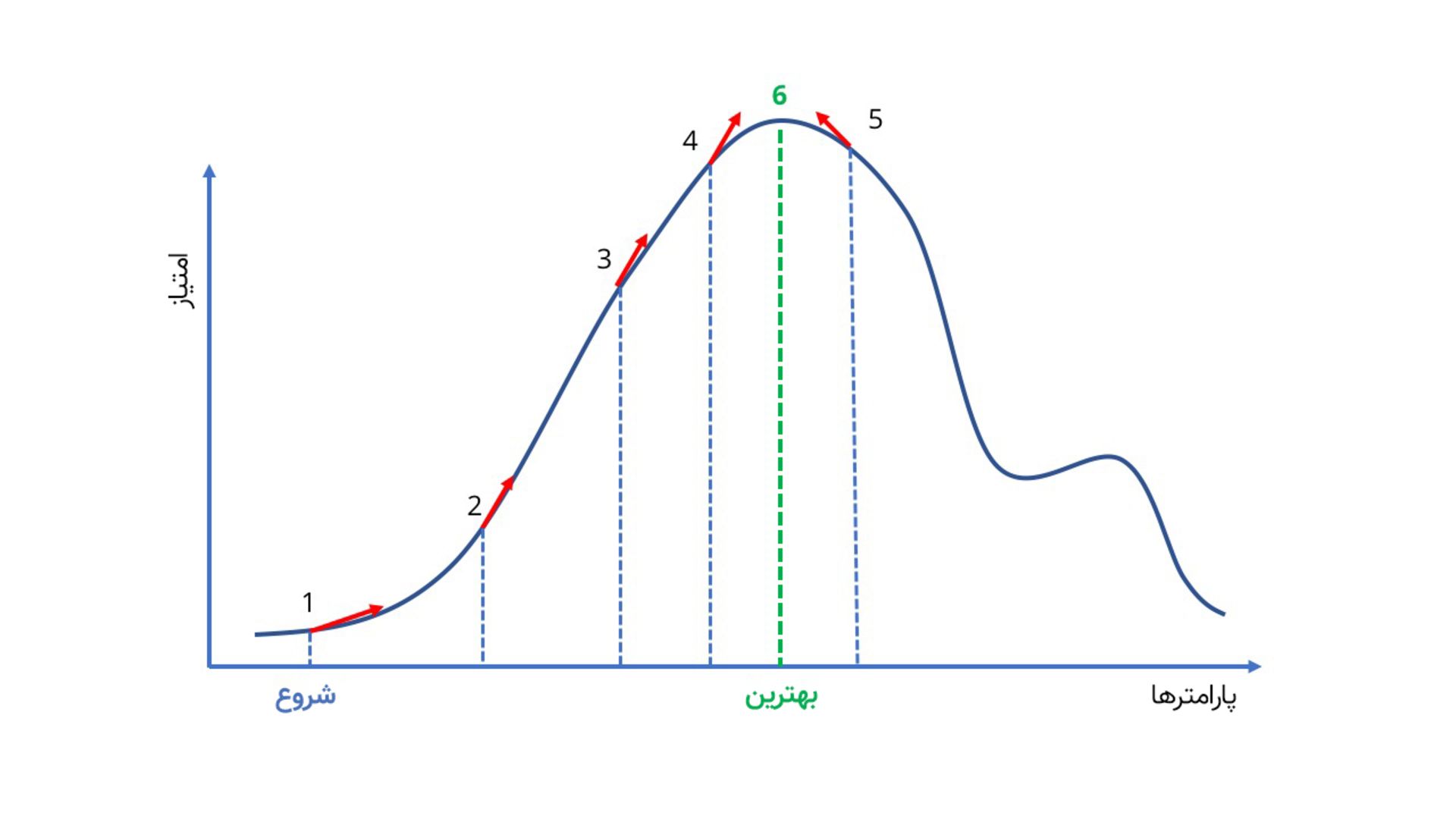

وقتي از «حافظه» مدل صحبت ميكنيم، منظورمان مجموعهاي از پارامترهاي عددي است كه بر نحوهي پاسخدهي مدل به سوالات، نظارت ميكند. از اين رو، وقتي از يادگيري مدل حرف ميزنيم، منظورمان تغيير و تنظيم اين پارامترها بهگونهاي است كه مدل بهترين پاسخ ممكن را به سوالات ما بدهد.

مثلا با مدل انجيرها، ما سعي داشتيم معادلهاي براي رسم يك خط بنويسيم كه يك مسئلهي رگرسيون ساده است و فرمولهايي وجود دارند كه ميتوانند تنها در يك مرحله، جواب سوال ما را پيدا كنند. اما مدلهاي پيچيدهتر طبيعتا به مراحل بيشتري نياز دارند. يك شبكهي عصبي عميق ميتواند ميليونها پارامتر داشته باشد و مجموعه دادهاي كه براساس آن يادگيري ديده ممكن است با ميليونها مثال روبهرو شود؛ براي اين مدل، هيچ راهحل يكمرحلهاي وجود ندارد.

ميتوان كار را با يك شبكه عصبي ناقص شروع و در ادامه آن را بهتر كرد

خوشبختانه براي اين چالش، يك ترفند عجيب وجود دارد؛ اينكه ميتوان كار را با يك شبكهي عصبي ضعيف و ناقص شروع كرد و بعد با انجام تغييرات، آن را بهبود بخشيد. يادگيري مدلهاي يادگيري ماشين با اين روش شبيه اين است كه از دانشآموزان مرتب امتحان بگيريم. هر بار جوابي را كه مدل فكر ميكند صحيح است با جوابي كه واقعا صحيح است، مقايسه ميكنيم و به آن نمره ميدهيم. بعد سعي ميكنيم مدل را بهتر كرده و دوباره از آن امتحان بگيريم.

اما از كجا بدانيم چه پارامترهايي را بايد تغيير دهيم و ميزان اين تغييرات چقدر باشد؟ شبكههاي عميق يك ويژگي جالب دارند كه بهموجب آن، نه تنها ميتوانيم براي بسياري از انواع مسائل، نمرهي آزمون بهدست آوريم، بلكه ميتوانيم بهطور دقيق حساب كنيم با تغيير هر پارامتر، نمرهي آزمون چقدر تغيير ميكند. بدينترتيب، آنقدر پارامترها را تغيير ميدهيم تا بالاخره به نمرهي كامل ۲۰ برسيم و مدل ديگر جايي براي بهبود نداشته باشد. به اين كار اغلب تپهنوردي (Hill Climbing) گفته ميشود، چون اگر همينطور به بالا رفتن از تپه ادامه دهيد، سرانجام به نوك قله ميرسيد و صعود بيشتر ممكن نيست.

براي بهبود شبكه عصبي از روش «تپهنوردي» استفاده ميكنند

اين روش بهبود شبكهي عصبي را آسانتر ميكند. اگر شبكهي ما ساختار خوبي داشته باشد، ديگر لازم نيست هر بار با اضافه شدن دادههاي جديد، كارمان را از نو شروع كنيم. ميتوان كار را با همان پارامترهاي موجود شروع كرد و بعد مدل را با دادههاي جديد يادگيري داد. برخي از برجستهترين مدلهاي هوش مصنوعي امروزي، از ابزار تشخيص تصوير گربه فيسبوك گرفته تا آنچه فروشگاههاي زنجيرهاي Amazon Go براي انجام خريدهاي بدون نياز به فروشنده استفاده ميكنند، براساس همين تكنيك ساده ايجاد شدهاند.

علاوهبراين، به كمك روش «تپهنوردي» ميتوان از يك شبكهي عصبي يادگيري ديده براي يك منظور خاص، براي هدف ديگري استفاده كرد. مثلا اگر هوش مصنوعي خود را براي تشخيص تصوير گربه يادگيري داده باشيد، ميتوانيد خيلي راحت آن را براي تشخيص تصوير سگ يا زرافه تعليم دهيد.

انعطافپذيري شبكههاي عصبي، حجم انبوه دادههاي اينترنتي، رايانش موازي و GPUهاي قدرتمند روياي هوش مصنوعي را محقق كرده است

به خاطر همين انعطافپذيري شبكههاي عصبي است كه هوش مصنوعي در هفت، هشت سال گذشته به پيشرفتهاي بزرگي دست پيدا كرده است. از آن طرف هم اينترنت مدام درحال توليد حجم انبوهي از داده است و رايانش موازي دركنار پردازندههاي گرافيكي قدرتمند، كار با اين حجم از داده را ممكن كرده است. و در نهايت، بهكمك شبكههاي عصبي عميق توانستيم از اين مجموعه داده براي توليد مدلهاي يادگيري ماشين بسيار پيچيده و قدرتمند استفاده كنيم.

بدينترتيب، تمام كارهايي كه انجامشان در زمان آلن تورينگ تقريباً غيرممكن بود، حالا بهراحتي امكانپذير است.

كاربرد هوش مصنوعي

حالا كه با انواع هوش مصنوعي و سازوكار آنها آشنا شديم، سوال بعدي اين است كه در حال حاضر با آن چه كاري ميتوانيم بكنيم؟ متخصصد هوش مصنوعي بهطور كلي در چهار زمينه تعريف ميشود: تشخيص اجسام، تشخيص چهره، تشخيص صدا و شبكههاي مولد.

تشخيص اجسام (Object Recognition)

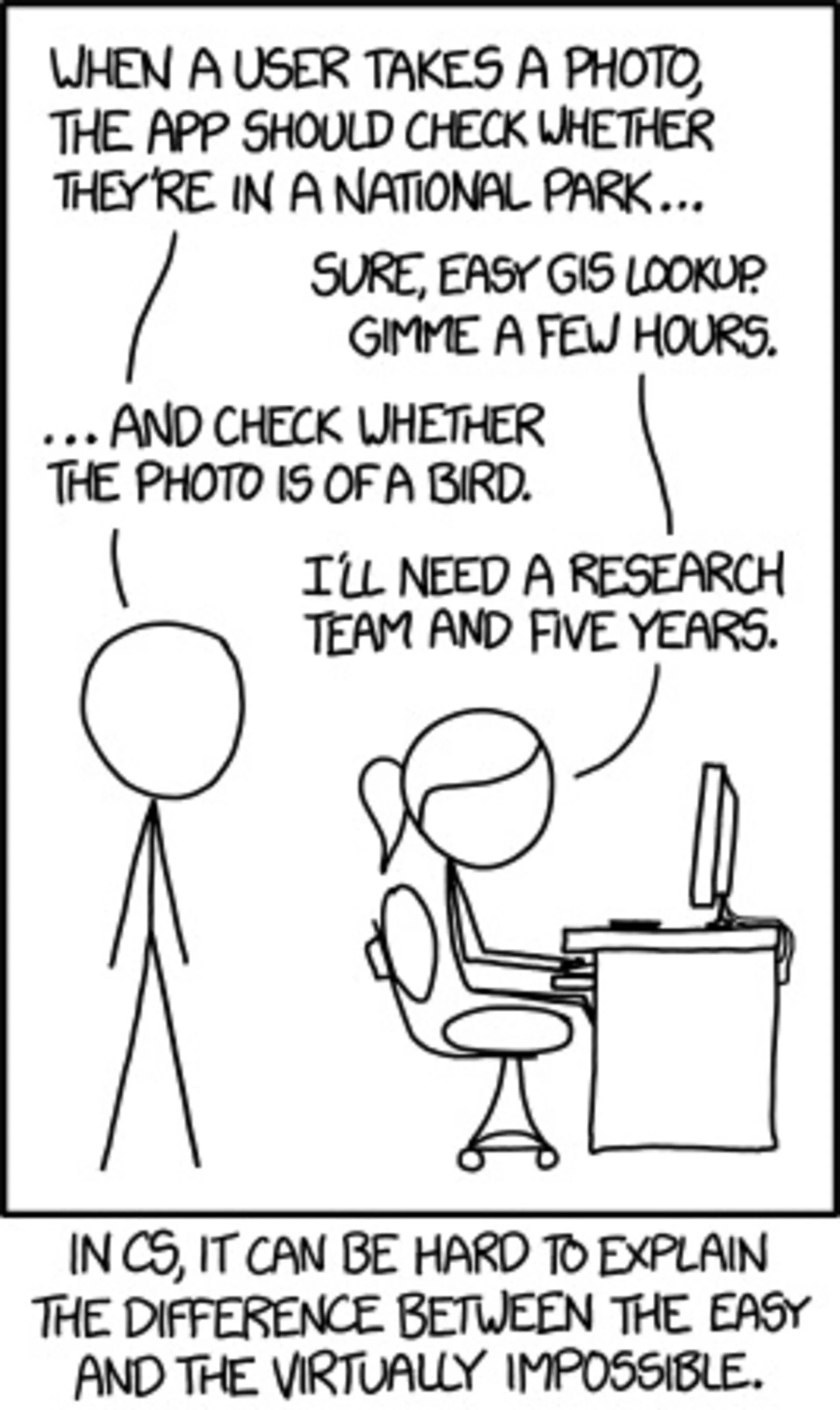

شايد بتوان گفت حوزهاي كه يادگيري عميق بيشترين و سريعترين تاثير را در آن داشته، بينايي ماشين (Computer Vision)، بهويژه در تشخيص اجسام مختلف در تصاوير است. همين چند سال پيش، وضعيت پيشرفت هوش مصنوعي در زمينهي تشخيص اجسام به قدري اسفبار بود كه در كاريكاتور زير بهخوبي نمايش داده شده است.

مرد: ميخوام كه وقتي متخصص عكس ميگيره، اپليكيشن بتونه تشخيص بده كه عكس مثلا تو پارك ملي گرفته شده…

زن: حله. فقط كافيه يه نگاهي به جيآياس بندازم. يه چند ساعت بيشتر وقت نميبره.

مرد: ...و اينكه مثلا توي عكس پرنده هم بوده يا نه.

زن: خب واسه اين يه تيم پژوهشي لازم دارم با پنج سال زمان.

امروزه، تشخيص پرندهها و حتي نوع خاصي از پرنده در عكس آنقدر كار آساني است كه حتي يك دانشآموز دبيرستاني هم ميتواند آن را انجام دهد. يعني در اين چند سال چه اتفاقي افتاده است؟

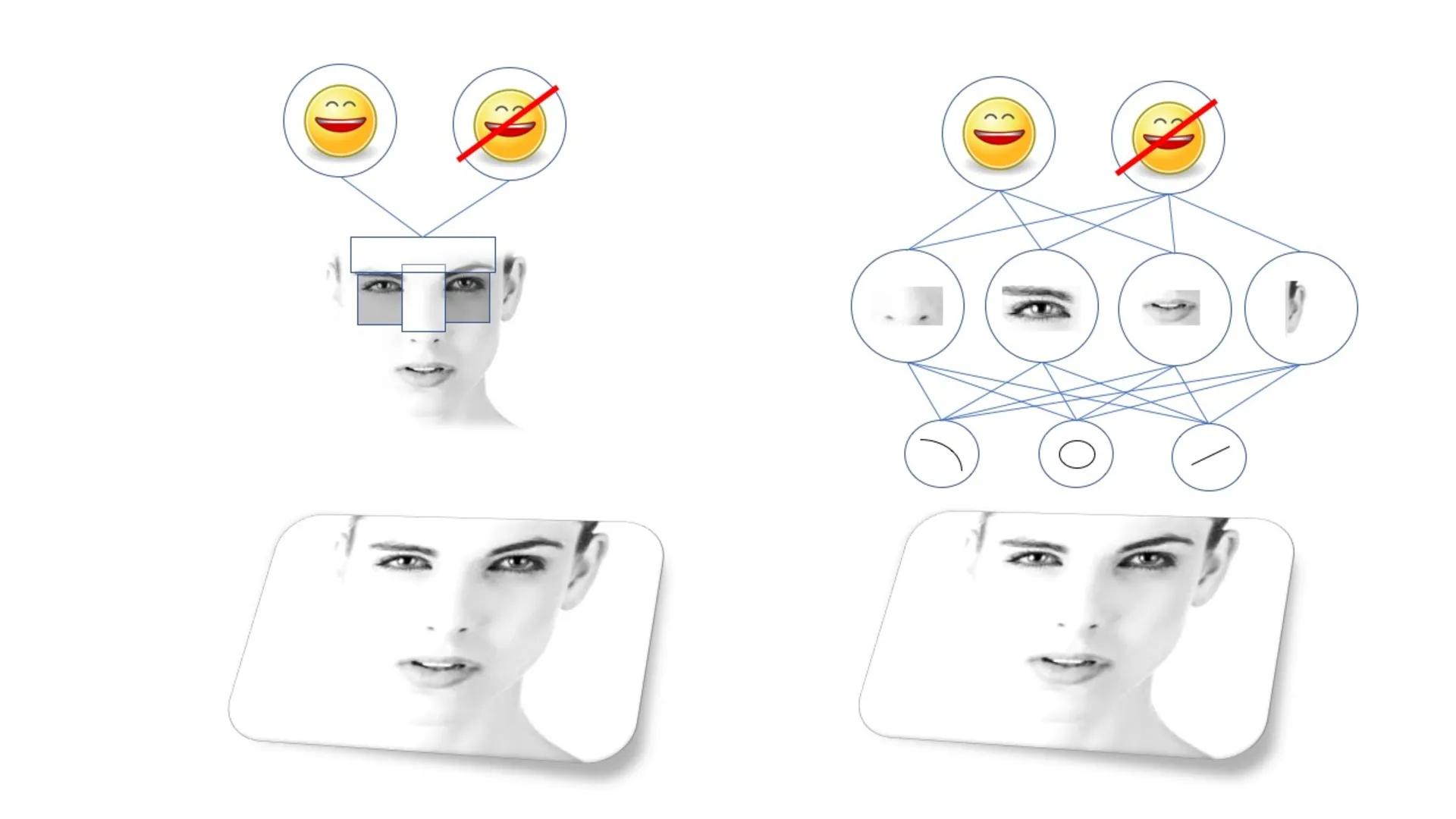

ايدهي تشخيص اشيا توسط ماشين را ميتوان به راحتي توصيف كرد، اما اجراي آن دشوار است. اجسام پيچيده از مجموعههايي از اجسام سادهتر ساخته شدهاند كه آنها نيز خود از شكلها و خطوط سادهتري ايجاد شدهاند. مثلا چهرهي افراد از چشم و بيني و دهان تشكيل شده كه خود اينها هم از دايره و خطوط و غيره تشكيل شدهاند. پس براي تشخيص چهره لازم است كه الگوهاي اجزاي چهره را تشخيص داد.

هر جسم پيچيدهاي از مجموعهاي از اجسام و الگوهاي سادهتري ساخته شده است؛ الگوريتمها به دنبال اين الگوها هستند

به اين الگوها ويژگي (Feature) ميگويند و تا پيش از ظهور يادگيري عميق، لازم بود آنها را دستي ايجاد كرد و كامپيوترها را طوري يادگيري داد تا بتوانند آنها را پيدا كنند. مثلا، الگوريتم تشخيص چهرهي معروفي به نام «ويولا-جونز» (Viola-Jones) وجود دارد كه ياد گرفته ابرو و بيني معمولا از اعماق چشم روشنتر هستند؛ درنتيجه، الگوي ابرو و بيني شبيه يك طرح T شكل روشن با دو نقطهي تاريك براي چشمها است. الگوريتم هم براي تشخيص چهره در تصاوير دنبال اين الگو ميگردد.

الگوريتم ويولا-جونز خيلي خوب و سريع كار ميكند و قابليت تشخيص چهرهي دوربينهاي ارزان مبتني بر همين الگوريتم است. اما بديهي است كه تمام چهرهها از اين الگوي ساده پيروي نميكنند. چندين تيم از پژوهشگران برجسته مدتها روي الگوريتمهاي بينايي ماشين كار كردند تا آنها را تصحيح كنند؛ اما آنها نيز همچنان ضعيف و پر از باگ بودند.

تا اينكه پاي يادگيري ماشين، بهويژه نوعي شبكهي عصبي عميق به اسم «شبكهي عصبي پيچشي» (Convolutional Neural Network) معروف به CNN به ميان آمد و انقلاب بزرگي در الگوريتمهاي تشخيص اجسام به وجود آورد.

شبكههاي عصبي پيچشي يا همان CNNها، ساختار خاصي دارند كه از روي قشر بينايي مغز پستانداران الهام گرفته شده است. اين ساختار به CNN اجازه ميدهد تا به جاي اينكه تيمهاي متعددي از پژوهشگران بخواهند سالها صرف پيدا كردن الگوهاي درست بكنند، خودش با يادگيري مجموعه خطوط و الگوها، اشياي حاضر در تصاوري را تشخيص دهد.

شبكههاي CNN براي استفاده در بينايي ماشين فوقالعادهاند و خيلي زود پژوهشگران توانستند آنها را براي تمام الگوريتمهاي تشخيص بصري، از گربههاي داخل تصوير گرفته تا عابران پياده از ديد دوربين خودروهاي خودران، يادگيري دهند.

علاوهبراين، قابليت CNNها بهخاطر سازگاري بيدردسر با هر مجموعه داده باعث فراگيري و محبوبيت سريع آنها شده است. فرايند تپهنوردي را به خاطر داريد؟ اگر دانشآموز دبيرستاني ما بخواهد الگوريتمش نوع خاصي از پرنده را تشخيص دهد، تنها كافي است يكي از چندين شبكهي بينايي ماشين را كه بهصورت متنباز و رايگان دردسترس است، انتخاب كرده و بعد آن را براساس مجموعه دادهي خودش يادگيري دهد، بدون آنكه لازم باشد از رياضي و فرمولهاي پشت پردهي اين شبكه سر در بياورد.

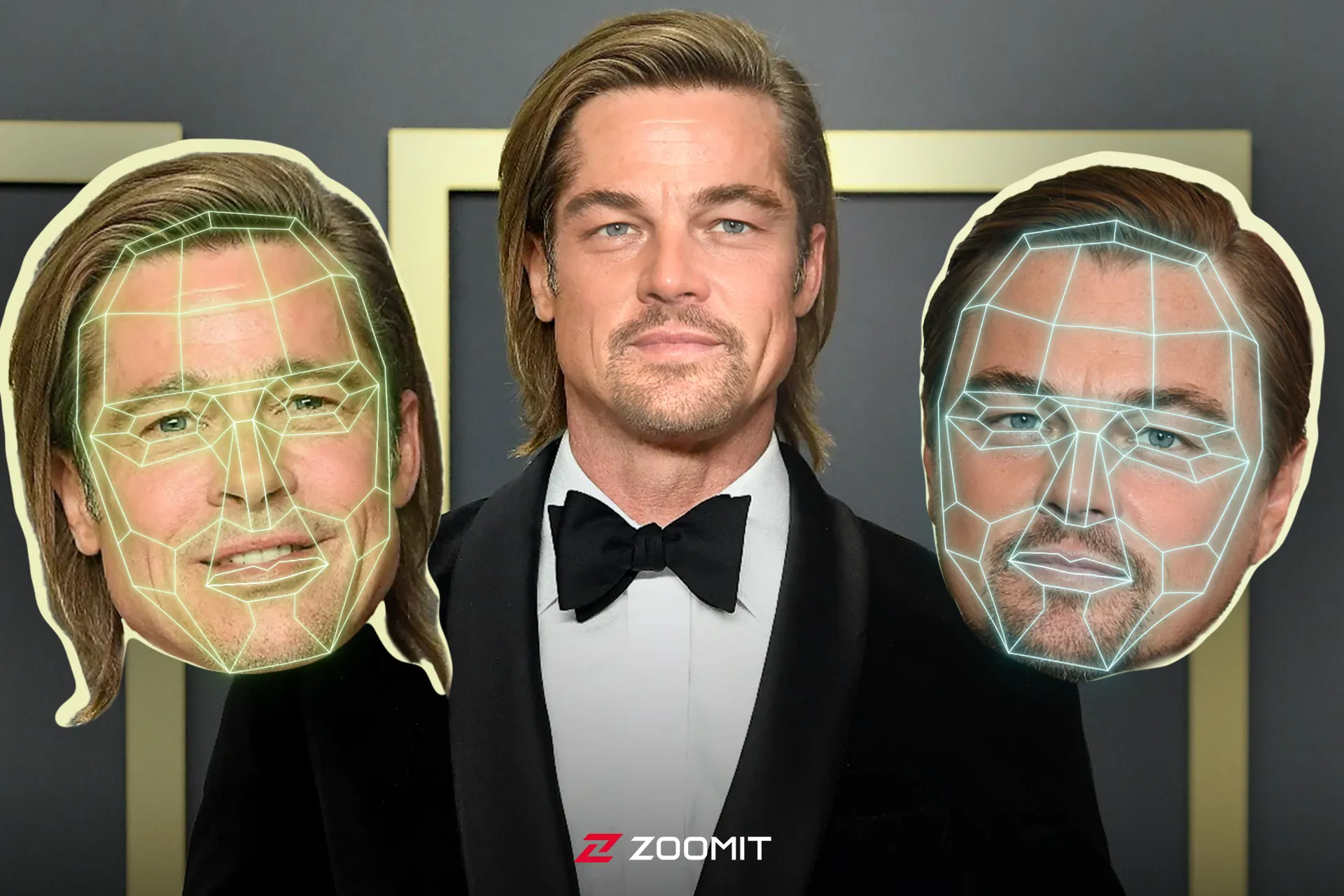

تشخيص چهره (Face Recognition)

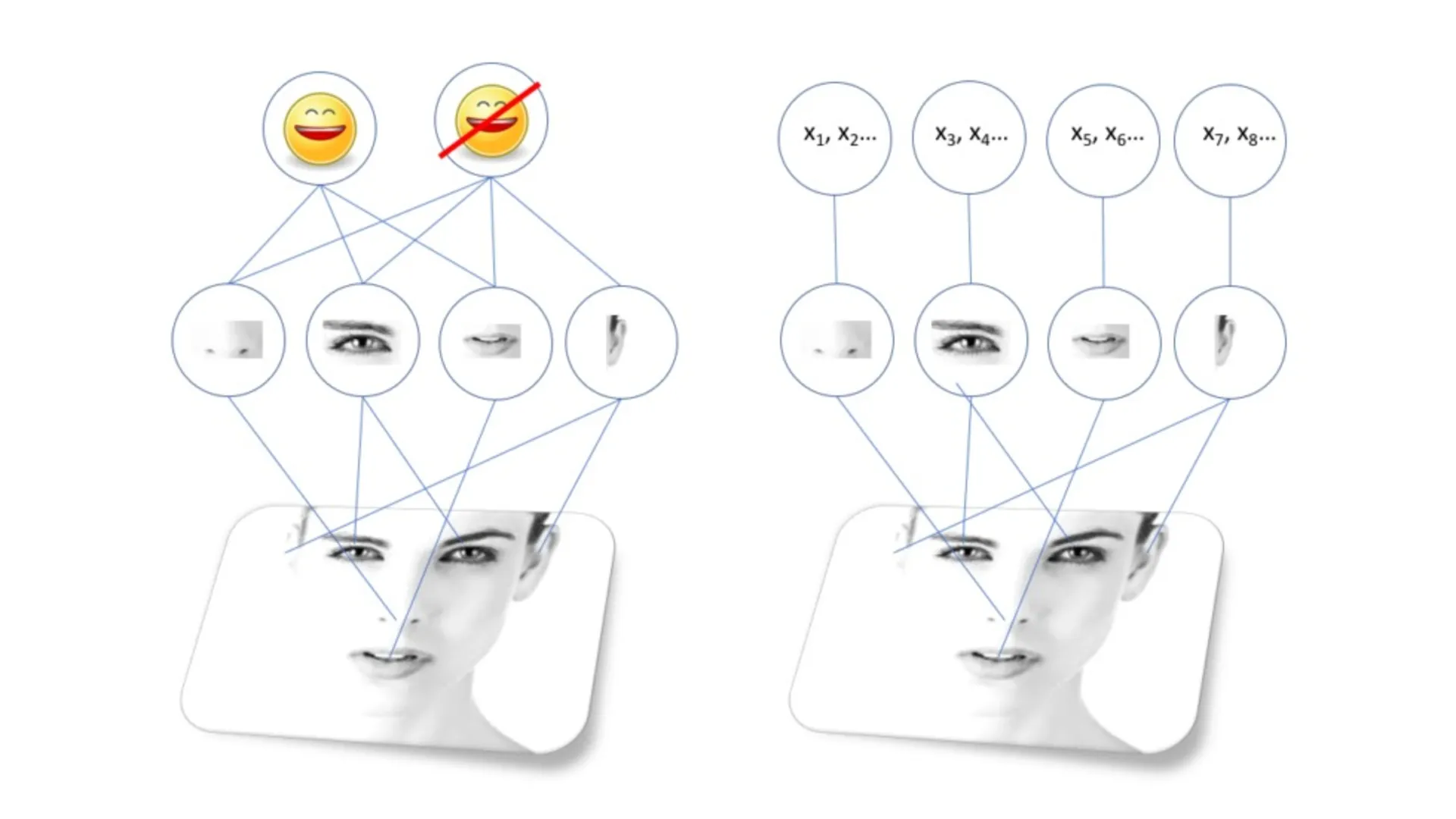

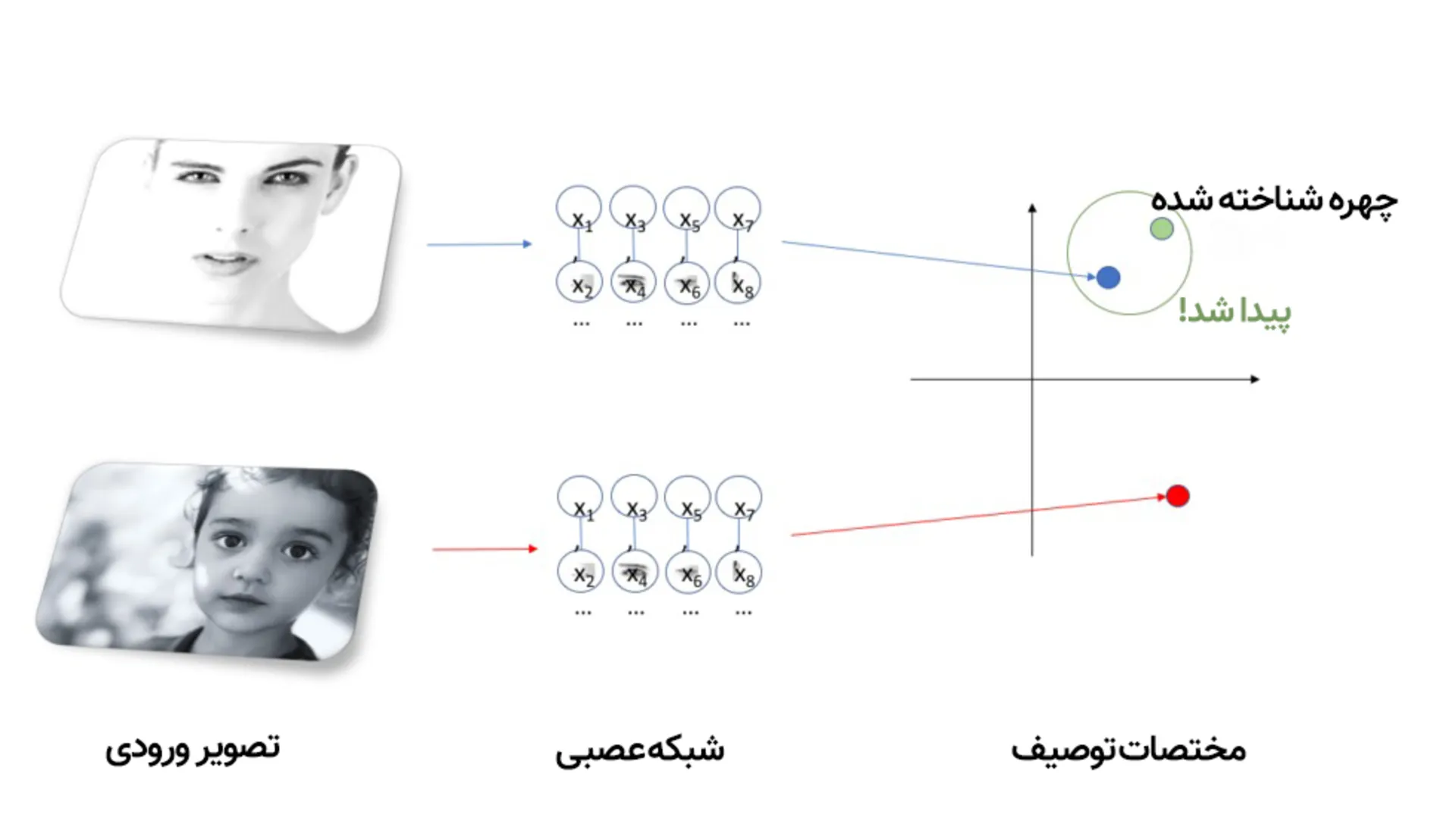

فرض كنيد ميخواهيم شبكهاي را يادگيري دهيم كه نه تنها بتواند چهرهها را بهطور كلي تشخيص دهد(يعني بتواند بگويد در اين عكس، انسان وجود دارد)، بلكه بتواند تشخيص دهد كه اين چهره دقيقا متعلق به كيست.

براي اين كار، شبكهاي را كه قبلا براي تشخيص كلي چهرهي انسان يادگيري ديده است، انتخاب ميكنيم. بعد، خروجي را عوض ميكنيم. يعني به جاي اينكه از شبكه بخواهيم چهرهاي خاص را در ميان جمعيت تشخيص دهد، از آن ميخواهيم توصيفي از آن چهره را بهصورت صدها عددي كه ممكن است فرم بيني يا چشمها را مشخص كند، به ما نشان دهد. شبكه از آنجايي كه از قبل ميداند اجزاي تشكيلدهندهي چهره چيست، ميتواند اين كار را انجام دهد.

البته كه ما اين كار را به طور مستقيم انجام نميدهيم؛ بلكه شبكه را با نشان دادن مجموعهاي از چهرهها و بعد مقايسهي خروجيها با يكديگر يادگيري ميدهيم. همچنين ميتوانيم به شبكه ياد دهيم چطور چهرههاي يكساني را كه شباهت زيادي به هم دارند و چهرههاي متفاوتي را كه اصلا شبيه هم نيستند، توصيف كند.

حالا تشخيص چهره آسان ميشود؛ ابتدا، تصوير چهرهي اول را به شبكه ميدهيم تا آن را برايمان توصيف كند. بعد، تصوير چهرهي دوم را به شبكه ميدهيم و توصيف آن را با توصيف چهرهي اول مقايسه ميكنيم. اگر دو توصيف به هم نزديك باشد، ميگوييم كه اين دو چهره يكي هستند. بدينترتيب، از شبكهاي كه فقط ميتوانست يك چهره را تشخيص دهد به شبكهاي رسيديم كه ميتواند هر چهرهاي را تشخيص دهد!

شبكههاي عصبي عميق بهطرز فوقالعادهاي انعطافپذير هستند

شبكههاي عصبي عميق دقيقا بهخاطر همين ساختار منعطف بهشدت متخصصدي هستند. به كمك اين تكنولوژي، انواع بسيار زيادي از مدلهاي يادگيري ماشين براي بينايي كامپيوتر توسعه يافتهاند و اگرچه متخصصد آنها متفاوت است، بسياري از ساختارهاي اصلي آنها براساس شبكههاي CNN اوليه نظير Alexnet و Resnet ساخته شده است.

جالب است بدانيد برخي افراد از شبكههاي تشخيص چهره حتي براي خواندن خطوط نمودارهاي زماني استفاده كردهاند! يعني به جاي اينكه بخواهند براي تجزيهوتحليل داده، يك شبكهي سفارشي ايجاد كنند، شبكهي عصبي متنبازي را طوري يادگيري ميدهند تا بتواند به شكل خطوط نمودارها هم شبيه چهرهي انسانها نگاه كند و الگوها را توصيف كند.

اين انعطافپذيري عالي است، اما بالاخره جايي كم ميآورد. براي همين، حل برخي مسائل به نوع ديگري از شبكه نياز دارد كه در ادامه با آنها آشنا ميشويد.

تشخيص گفتار (Speech Recognition)

شايد بتوان گفت تكنيك تشخيص گفتار بهنوعي شبيه تشخيص چهره است، به اين صورت كه سيستم ياد ميگيرد به چيزهاي پيچيده به شكل مجموعهاي از ويژگيهاي سادهتر نگاه كند. در مورد گفتار، شناخت جملهها و عبارات از شناخت كلمات حاصل ميشود كه آنها هم خود به دنبال تشخيص هجاها يا بهعبارت دقيقتر، واجها ميآيند. بنابرين وقتي ميشنويم كسي ميگويد «باند، جيمز باند» درواقع ما داريم به دنبالهاي از صداهاي متشكل از BON+DUH+JAY+MMS+BON+DUH گوش ميدهيم.

در حوزهي بينايي ماشين، ويژگيها بهصورت مكاني سازماندهي ميشوند كه ساختار CNN هم قرار است همين مكانها را تشخيص دهد. اما درمورد تشخيص گفتار، ويژگيها بهصورت زماني دستهبندي ميشوند. افراد ممكن است آهسته يا سريع صحبت كنند، بيآنكه نقطهي شروع يا پايان صحبتشان معلوم باشد. ما مدلي ميخواهيم كه مثل انسانها بتواند به صداها در همان لحظه كه ادا ميشوند، گوش دهد و آنها را تشخيص دهد؛ بهجاي اينكه منتظر بماند تا جمله كامل شود. متاسفانه برخلاف فيزيك، نميتوانيم بگوييم مكان و زمان يكي هستند و داستان را همينجا تمام كنيم.

اگر با دستيار صوتي موبايلتان كار كرده باشيد، احتمالا زياد پيش آمده كه Siri يا گوگل اسيستنت بهخاطر شباهت هجاها، حرف شما را اشتباه متوجه شده باشد. مثلا به گوگل اسيستنت ميگوييد «what's the weather»، اما فكر ميكند از او پرسيدهايد «what's better». براي اينكه اين اشكال حل شود، به مدلي نياز داريم كه بتواند به دنبالهي هجاها در بستر متن توجه كند. اينجا است كه دوباره پاي يادگيري ماشين به ميان ميآيد. اگر مجموعهي كلمات ادا شده بهاندازه كافي بزرگ باشد، ميتوان ياد گرفت كه محتملترين عبارات كدامها هستند و هرچه تعداد مثالها بيشتر باشد، پيشبيني مدل بهتر ميشود.

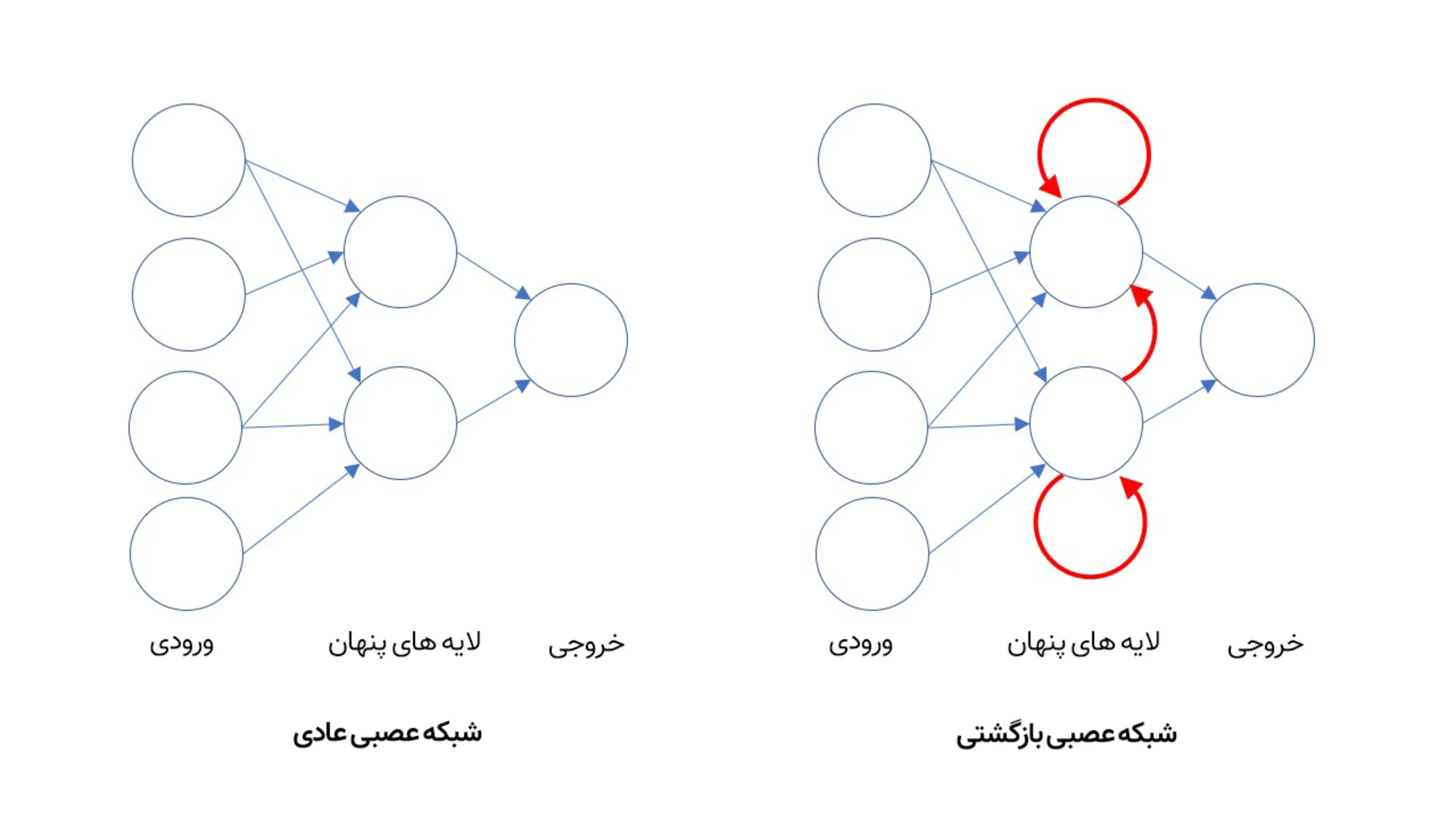

براي اين كار، از شبكه عصبي بازگشتي يا همان RNN استفاده ميشود. در اكثر شبكههاي عصبي مانند شبكههاي CNN كه براي بينايي كامپيوتر به كار ميروند، اتصالات نورونها تنها در يك جهت و از سمت ورودي به خروجي جريان دارد. اما در يك شبكهي عصبي بازگشتي، خروجي نورونها را ميتوان به همان لايه كه در آن قرار دارند يا حتي به لايههاي عميقتر فرستاد. بدينترتيب، شبكههاي RNN ميتوانند صاحب حافظه شوند.

شبكه CNN يكطرفه است، اما شبكه RNN حافظه داخلي دارد

شبكهي CNN يكطرفه است؛ به آن يك تصوير بهعنوان ورودي بدهيد تا توصيف تصوير را بهصورت خروجي به شما تحويل دهد. اما شبكهي RNN به نوعي حافظهي داخلي دسترسي دارد و يادش ميماند كه قبلا چه تصاويري بهصورت ورودي به آن داده شده و ميتواند پاسخهايش را هم مرتبط با چيزي كه دارد ميبيند و هم با چيزهايي كه قبلا ديده، ارائه دهد.

حافظهي RNN باعث ميشود اين شبكه نه تنها به تكتك هجاها به محض ادا شدن «گوش دهد»، بلكه ميتواند ياد بگيرد كه چه نوع هجاهايي كنار هم مينشينند تا يك كلمه را تشكيل دهند و همينطور ميتواند پيشبيني كند كه چه نوع عبارات و جملههايي محتملتر هستند. درنتيجه، شبكه RNN به دستيار صوتي ياد ميدهد كه گفتن «what's the weather» از «what's better» محتملتر است و متناسب با همين پيشبيني، به شما پاسخ ميدهد.

به كمك RNN ميتوان بهخوبي گفتار انسان را تشخيص داد و آن را به متن تبديل كرد؛ عملكرد اين شبكهها بهقدري بهبود يافته كه از انديشه متخصصين دقت تشخيص حتي از انسانها هم بهتر عمل ميكنند. البته دنبالهها فقط در صدا نمايان نميشوند. امروزه از شبكههاي RNN براي تشخيص دنبالهي حركات در ويديوها نيز استفاده ميشود.

ديپفيك و شبكههاي مولد (Deepfakes and Generative AI)

تا اينجاي مطلب فقط داشتيم دربارهي مدلهاي يادگيري ماشيني صحبت ميكرديم كه براي تشخيص به كار ميروند؛ مثلا از مدل ميخواستيم به ما بگويد در اين تصوير چه ميبيند يا چيزي را كه گفته شده، درك كند. اما اين مدلها قابليتهاي بيشتري دارند. همانطور كه احتمالا از كار كردن با چتباتها و پلتفرم Dall-E متوجه شديد، مدلهاي يادگيري عميق اين روزها ميتوانند براي توليد محتوا هم به كار روند!

حتما نام ديپفيك (Deep Fake) را زياد شنيدهايد؛ ويديوهاي جعلي كه در آن افراد مشهور چيزهايي ميگويند يا كارهايي ميكنند كه به انديشه متخصصين واقعي ميرسد، اما اينطور نيست. ديپفيك هم نوع ديگري از هوش مصنوعي مبتنيبر يادگيري عميق است كه در محتواي صوتي و تصويري دست ميبرد و آن را بهدلخواه تغيير ميدهد تا نتيجهي نهايي چيزي كاملا متفاوت از محتواي اوليه باشد.

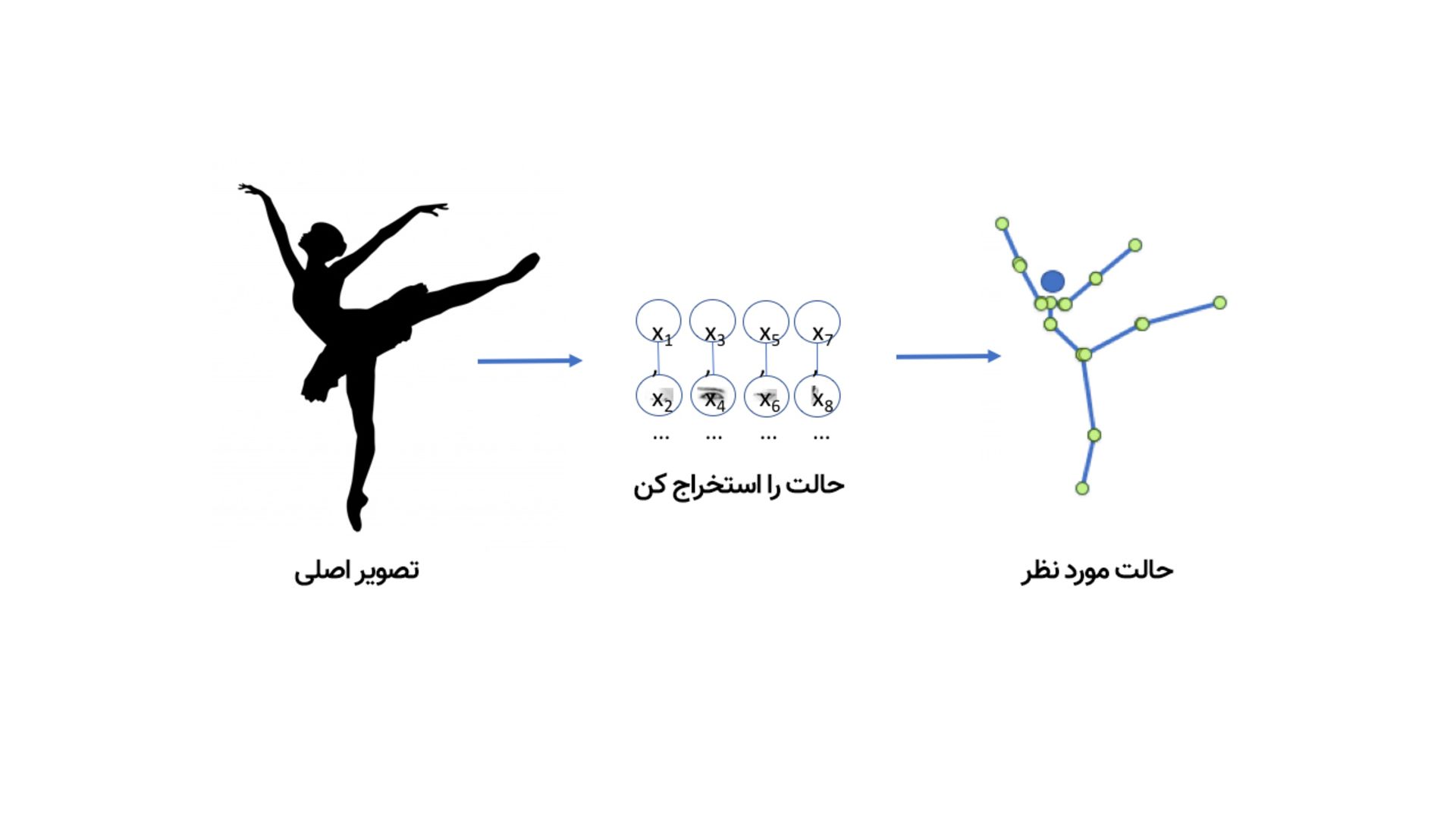

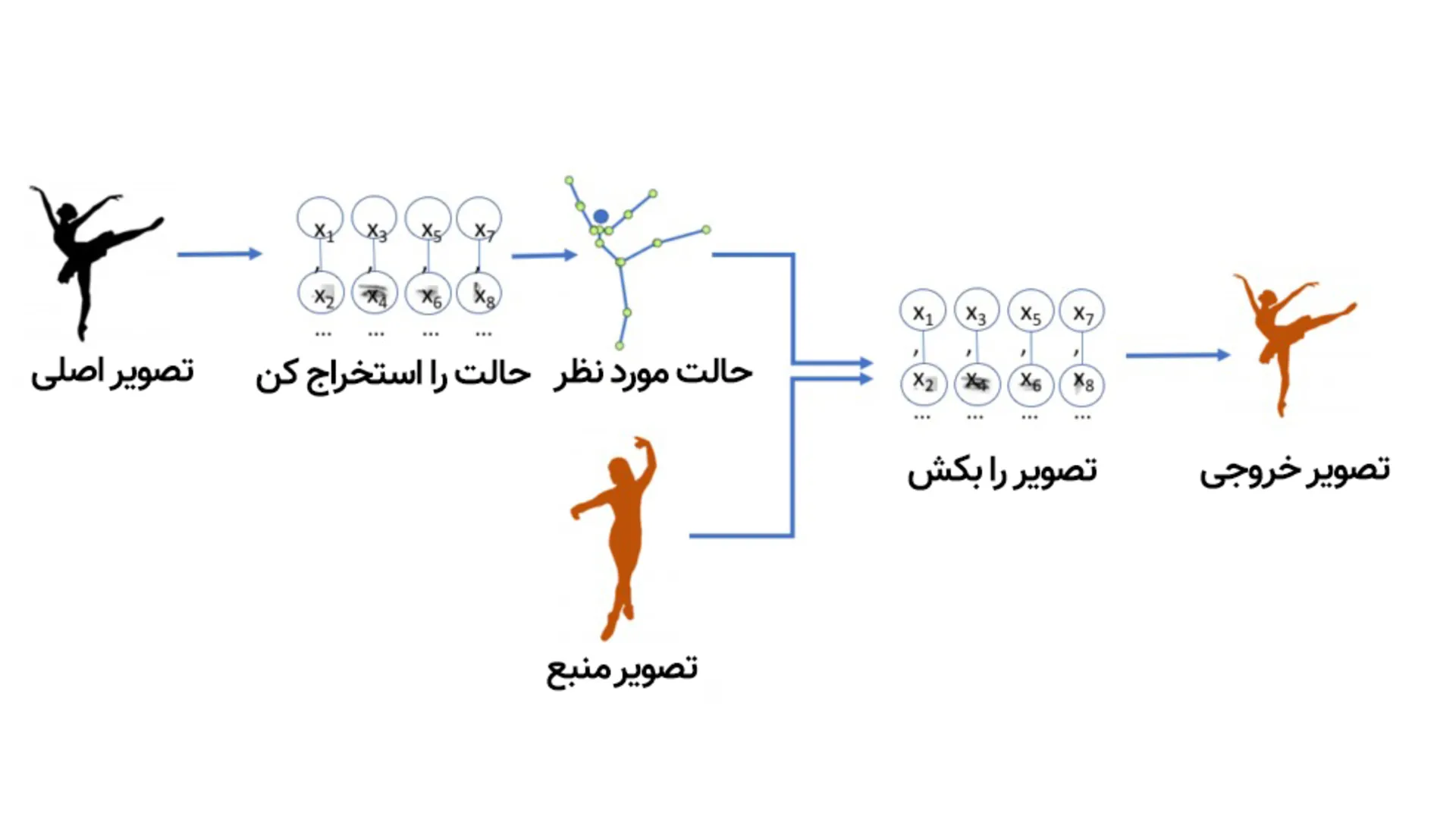

به اين ويديوي ديپفيك نگاه كنيد؛ مدلي كه در ساخت اين ديپفيك بهكار رفته ميتواند ويديوي رقص يك فرد را تجزيهوتحليل كند و بعد با پيدا كردن الگوها، همان حركات موزون را در ويديوي دوم روي فرد ديگري پياده كند؛ طوري كه فرد حاضر در ويديوي دوم دقيقا شبيه ويديوي اول به رقص درميآيد.

با تمام تكنيكهايي كه تا اينجا توضيح داديم، يادگيري شبكهاي كه تصوير يك فرد در حال رقص را دريافت كند و بتواند بگويد دستها و پاهايش در چه موقعيت مكانياي قرار دارند، كاملا شدني است. اين شبكه همچنين ياد گرفته كه چطور پيكسلهاي يك تصوير را به موقعيت قرار گرفتن دستها و پاها مربوط كند. با توجه به اينكه برخلاف مغز واقعي، شبكهي نوروني هوش مصنوعي صرفا دادههايي هستند كه در يك كامپيوتر ذخيره شدهاند، بيشك اين امكان وجود دارد كه اين داده را برداشته و برعكس اين فرايند عمل كنيم؛ يعني از مدل بخواهيم از موقعيت دست و پا، پيكسلها را به دست آورد.

به مدلهاي يادگيري ماشين كه ميتوانند ديپفيك بسازند يا مثل Dall-E و Midjourney، متن توصيفي را به تصوير تبديل كنند، مدل مولد (Generative) ميگويند. تا بدينجا، از هر مدلي كه حرف زديم از نوع تميزدهنده (Discriminator) بود؛ به اين معني كه مدل به مجموعهاي از تصاوير نگاه ميكند و تشخيص ميدهد كدام تصوير گربه و كدام گربه نيست؛ اما مدل مولد همانطور كه از نامش پيدا است، ميتواند از توصيف متني گربه، تصوير گربه توليد كند.

مدلهاي مولدي كه براي «بهتصوير كشيدن» اجسام ساخته شدهاند، از همان ساختار CNN به كار رفته در مدلهاي تشخيص همان اجسام استفاده ميكنند و ميتوانند دقيقا به همان روش مدلهاي يادگيري ماشين ديگر يادگيري ببينند.

چالش ساخت مدل مولد تعريف سيستم امتيازدهي براي آن است

اما نكتهي چالشبرانگيز يادگيري مدلهاي مولد، تعريف سيستم امتيازدهي براي آنها است. مدلهاي تميزدهنده با پاسخ درست و نادرست يادگيري ميبينند؛ مثلا اگر تصوير سگ را گربه تشخيص دهند، ميتوان به آنها ياد داد كه پاسخ نادرست است. اما چطور ميتوان به مدلي كه تصوير گربهاي را كشيده، امتياز داد؟ مثلا اينكه چقدر نقاشياش خوب است يا چقدر به واقعيت نزديك است؟

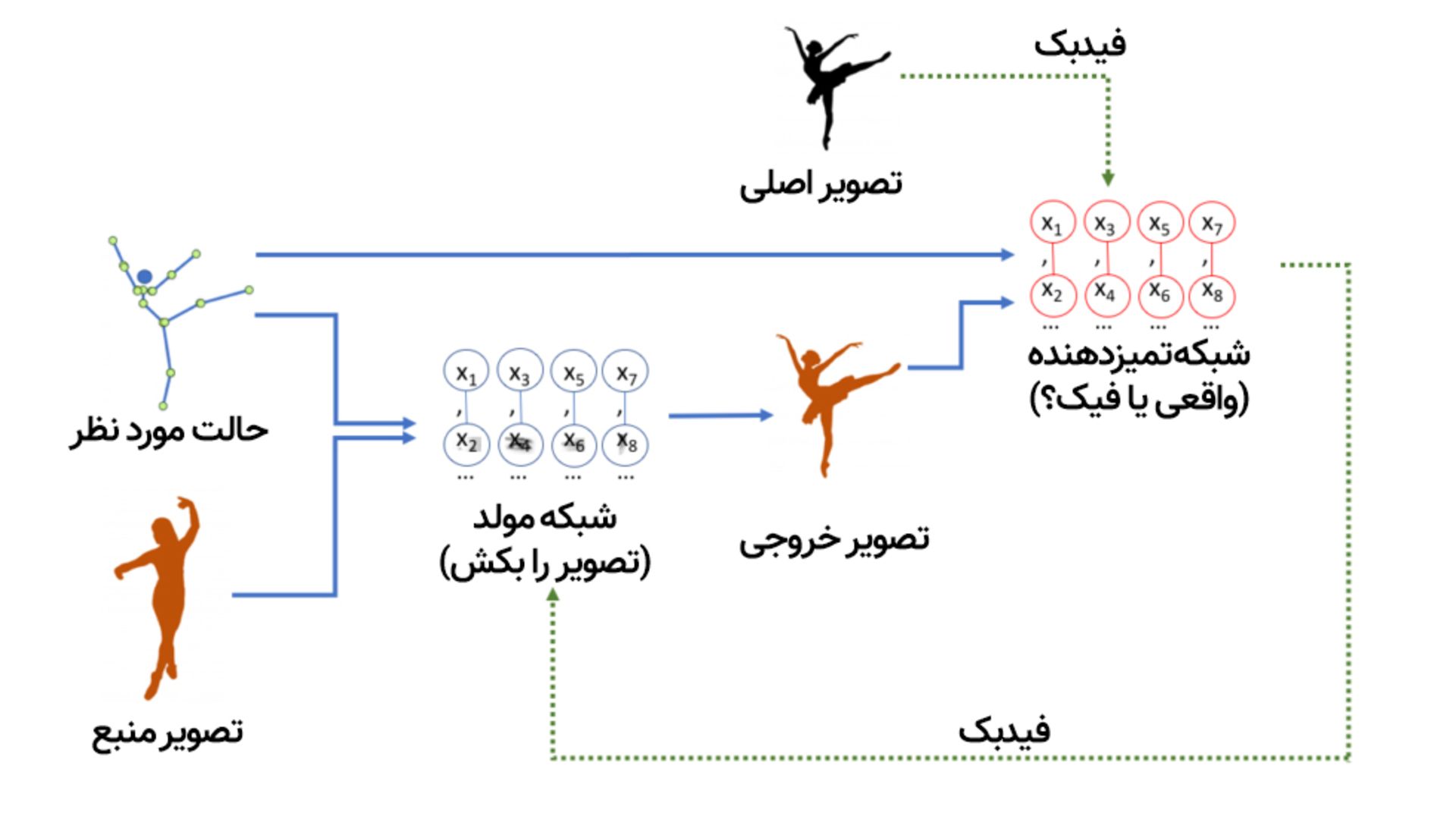

اينجا جايي است كه براي افراد بدبين به آينده و تكنولوژي، منظورم آنهايي است كه معتقدند دنيا قرار است به دست رباتهاي قاتل نابود شود، داستان واقعا ترسناك ميشود. چراكه بهترين روشي كه براي يادگيري شبكههاي مولد فعلا در اختيار داريم اين است كه به جاي اينكه ما خودمان آنها را يادگيري دهيم، اجازه دهيم شبكهي عصبي ديگري آنها را يادگيري دهد؛ يعني دو هوش مصنوعي رو در روي هم!

براي افرادي كه به آينده رباتهاي قاتل اعتقاد دارند، شبكه GAN داستان را ترسناك ميكند

اسم اين تكنيك، «شبكه مولد رقابتي» (Generative Adversarial Networks) يا GAN است. در اين روش، دو شبكهي عصبي داريم كه ضد يكديگر عمل ميكنند؛ از يك سمت شبكهاي داريم كه سعي دارد ويديوي فيك بسازد (مثلا موقعيت مكاني دست و پاهاي فرد در حال رقص را بردارد و روي فرد ديگري پياده كند) و در سمت ديگر، شبكهي ديگري است كه يادگيري ديده تا با استفاده از مجموعهاي از نمونه رقصهاي واقعي، تفاوت بين ويديوي واقعي و جعلي را تشخيص دهد.

در مرحلهي بعدي، اين دو شبكه در نوعي بازي رقابتي مقابل همديگر ميگيرند كه كلمهي «رقابتي» (Adversarial) از همينجا ميآيد. شبكهي مولد سعي مي كند فيكهاي قانعكنندهاي بسازد و شبكهي تميزدهنده سعي ميكند تشخيص دهد كه چه چيزي واقعي و چه چيزي جعلي است.

در هر دور يادگيري، مدلها بهتر و بهتر ميشوند. مثل اين ميماند كه يك جعلكنندهي جواهر را در برابر يك متخصص كارشناس باتجربه قرار دهيم و حالا هر دو بخواهند با بهتر و هوشمندتر شدن، حريف خود را شكست دهند. درنهايت، وقتي هر دو مدل بهاندازهي كافي بهبود پيدا كردند، ميتوان مدل مولد را بهصورت مستقل استفاده كرد.

مدلهاي مولد در توليد محتوا، چه تصويري، چه صوتي، چه متني و ويديويي فوقالعادهاند؛ مثلا همين چتبات ChatGPT كه اينروزها حسابي سروصدا بهپا كرده، از مدل زباني بزرگ مبتنيبر مدل مولد استفاده ميكند و ميتواند تقريبا به تمام درخواستهاي متخصصان، از توليد شعر و فيلمنامه گرفته تا نوشتن مقاله و كد، در عرض چند ثانيه پاسخ دهد؛ آنهم بهگونهاي كه نميتوان تشخيص داد پاسخ را انسان ننوشته است.

استفاده از شبكههاي GAN از اين جهت ترسناك است (البته براي افراد خيلي شكاك و بدبين!) كه نقش انسانها در يادگيري مدلها در حد ناظر است و تقريبا تمام فرايند يادگيري و يادگيري برعهدهي هوش مصنوعي است.

نمونههاي هوش مصنوعي

اين روزها هوش مصنوعي را ميتوان تقريبا در هر چيزي ديد؛ از دستيارهاي صوتي مثل Siri و الكسا گرفته تا الگوريتمهاي پيشنهاد فيلم و آهنگ در نتفليكس و اسپاتيفاي و خودروهاي خودران و رباتهايي كه در خط توليد مشغول به كارند. اما در چند وقت اخير، عرضهي برخي از نمونههاي هوش مصنوعي، صحبت دربارهي اين حوزه از تكنولوژي را سر زبانها انداختهاند كه در ادامه بهطور مختصر به آنها اشاره ميكنيم.

ChatGPT

ChatGPT نوعي چتبات آزمايشي يا بهتر است بگويم بهترين چتباتي است كه تاكنون در دسترس عموم قرار گرفته است. اين چتبات كه نوامبر ۲۰۲۲ توسط شركت OpenAI عرضه شد، مبتنيبر نسخهي ۳.۵ مدل زباني GPT است.

در وصف شگفتيهايChatGPT حرفهاي زيادي زده شده است. متخصصان با تايپ درخواستهاي خود در رابط متخصصي بهشدت سادهي اين چتبات، نتايج حيرتانگيزي دريافت ميكنند؛ از توليد شعر و آهنگ و فيلمنامه گرفته تا نوشتن مقاله و كد و پاسخ به هر سؤالي كه فكرش را بكنيد؛ و تمام اينها تنها در كمتر از ده ثانيه

حجم دادههايي كه ChatGPT با آنها يادگيري داده شده به حدي وسيع است كه خواندن تمام آنها به «هزار سال عمر انساني» نياز دارد. دادههايي كه در دل اين سيستم پنهان شده، دانش بينهايت بزرگي را دربارهي جهاني كه در آن زندگي ميكنيم، در خود جاي داده است و بههمين خاطر ميتواند تقريبا به تمام سوالهاي ما پاسخ دهد.

DALL-E

پلتفرم مولد تصوير DALL-E كه نامش از تركيب سالوادور دالي، نقاش سورئاليست و انيميشن WALL-E پيكسار گرفته شده است، يكي از جذابترين محصولات توسعهيافته در OpenAI است كه در آن، درخواستهاي متني متخصص در عرض چند ثانيه به آثار هنري شگفتانگيزي تبديل ميشود.

نسخهي اول DALL-E براساس مدل GPT-3 توسعه يافت و تنها به ايجاد تصاويري در ابعاد ۲۵۶ در ۲۵۶ پيكسل محدود بود. اما نسخهي دوم كه در آوريل ۲۰۲۲ وارد فاز بتاي خصوصي شد، جهش بزرگي در حوزهي مولدهاي تصوير مبتني بر هوش مصنوعي محسوب ميشود. تصاويري كه DALL-E 2 قادر به ايجاد آنها است، حالا ۱۰۲۴ در ۱۰۲۴ پيكسل هستند و از تكنيكهاي جديدي چون «inpainting» استفاده ميكنند كه در آن بخشهايي از تصوير به انتخاب متخصص با تصوير ديگري جايگزين ميشوند.

جادوي DALL-E و ديگر مولدهاي نظير آن نه صرفاً به شناخت اشيا بهصورت جداگانه بلكه در درك فوقالعادهي آنها از روابط بين اشيا است؛ بهطوري كه وقتي از آن ميخواهيد «فضانوردي سوار بر اسب» را ايجاد كند، خوب ميداند منظور شما از اين خواسته دقيقاً چيست.

درحالحاضر، افرادي كه به ChatGPT دسترسي دارند، ميتوانند از پلتفرم Dall-E نيز استفاده كنند.

Copilot

مايكروسافت در سال ۲۰۱۸ علاوهبر كسب حق امتياز GPT-3، ازطريق پلتفرم گيتهاب با OpenAI وارد همكاري شد تا ابزار هوش مصنوعي Copilot را توسعه دهند. Copilot درون برنامه ويرايشگر كد اجرا ميشود و به توسعهدهندگان در نوشتن كد كمك ميكند.

استفاده از Copilot براي دانشجويان تأييدشده و گردانندگان پروژههاي متنباز رايگان است و بهگفتهي گيتهاب، در فايلهايي كه Copilot در آنها فعال است، نزديك ۴۰ درصد كدها با اين ابزار نوشته ميشود. Copilot از مدل Codex شركت OpenAI توسعه يافته كه از نسل الگوريتم پرچمدار GPT-3 است.

Jukebox

سيستم Jukebox واقعاً حيرتانگيز است. كافي است به اين بات ژانر آهنگ و نام هنرمند و متن آهنگ را بدهيد تا نمونهاي از يك آهنگ جديد را از صفر تا صد برايتان توليد كند. در پروفايل ساندكلاد OpenAI، به نمونههايي از آهنگهاي توليدشده با هوش مصنوعي Jukebox ميتوانيد گوش كنيد. بهگفته اين شركت، متن آهنگها بهوسيلهي مدل زباني و تعدادي از پژوهشگران نوشته شده است.

به جز Jukebox، ابزار هوش مصنوعي جديد گوگل بهنام MusicLM هم قادر به توليد آهنگ براساس توضيح متني است؛ هرچند اين ابزار هنوز در دسترس عموم قرار نگرفته است.

بهگفتهي گوگل، MusicLM در مجموع با دادههاي متشكلاز ۲۸۰ هزار ساعت موسيقي يادگيري داده شده تا ياد بگيرد براساس توضيحات دريافتي، آهنگهايي منسجم و پيچيده توليد كند. بهعنوان مثال اين ابزار ميتواند با ارائهي دستور «آهنگ جاز با يك تكنوازي ساكسيفون و يك تكخوان» يا «آهنگ تكنو دههي ۹۰ با بيس كم و ضربات قدرتمند»، آهنگهاي بسيار باكيفيتي بسازد. خروجي اين هوش مصنوعي بسيار چشمگير است و به موسيقيهايي كه هنرمندان انساني ساختهاند، شباهت دارد.

Midjourney

ميدجرني هم مانند Dall-E نوعي بات تعاملي است كه از يادگيري ماشين براي ايجاد تصاوير مبتني بر متن استفاده ميكند. اين پلتفرم بر بستر ديسكورد قابل استفاده است و نسخهي رايگان آن به متخصصان اجازهي چند درخواست محدود را ميدهد. تمام درخواستهاي متخصصان ديگر و تصاوير توليد شده توسط ميدجرني در كانال ديسكورد اين پلتفرم قابلمشاهده است.

يكي از جذابيتهاي ميدجرني ساخت انواع مختلفي از يك تصوير يكسان است. به اين ترتيب ميتوان با كنار هم قرار دادن تصاوير يك انيميشن جذاب به سبك «استاپ موشن» ساخت. از انديشه متخصصين برخي، تصاوير توليد شده با ميدجرني كيفيت و خلاقيت بيشتري از DALL-E دارند.

New Bing

«بينگ جديد» درواقع همان موتور جستوجوي نامآشنا و البته بداقبال مايكروسافت است كه حالا به مدل هوش مصنوعي بسيار قدرتمندي مجهز شده تا هم تلاش دوبارهاي باشد براي پايان دادن به يكهتازي چندين سالهي موتور جستوجوي گوگل و هم روش جستوجوي ما در اينترنت را بهطور كامل زيرورو و آنطور كه مايكروسافت اميدوار است، بهتر از قبل كند.

اگر از قابليتهاي ChatGPT شگفتزده شدهايد، احتمالا از نسخهي بهكار رفته در بينگ بيشتر متحير شويد؛ چراكه مايكروسافت ميگويد مدل زباني مورداستفاده در بينگ، GPT-4 است كه به ۷۰۰ ميليارد پارامتر مجهز شده است. درضمن، چتبات بينگ به اينترنت متصل و اطلاعاتش هميشه بهروز است.

در بينگ جديد ميتوانيد سوال خود را با زبان طبيعي بپرسيد تا هوش مصنوعي با همان زبان طبيعي شروع به پاسخگويي كند. مايكروسافت ميگويد اين مدل پاسخدهي به درخواستهاي متخصصان از سرچ سنتي، متخصصديتر و مفيدتر است.

LaMDA

LaMDA نيز مانند ChatGPT، چتبات مبتنيبر يادگيري ماشين است كه براي صحبتكردن دربارهي هر نوع موضوعي طراحي شده است. اين چتبات كه مخفف Language Model for Dialogue Applications بهمعناي «مدل زباني براي متخصصدهاي مكالمهاي» است، برپايهي معماري شبكهي عصبي ترنسفورمر ايجاد شده كه گوگل آن را در سال ۲۰۱۷ طراحي كرده بود؛ شبكهاي كه دقيقا در ساخت ChatGPT نيز به كار رفته است.

گوگل كماكان از عرضهي عمومي لمدا سرباز ميزند؛ اما سال گذشته اين چتبات پس از آنكه يكي از متخصصان گوگل مدعي شد به خودآگاهي رسيده، حسابي خبرساز شد. اين فرد در ادعايي جنجالي كه منجر به اخراجش از گوگل شد، گفت LaMDA احساسات و تجربيات ذهني دارد؛ بههميندليل، خودآگاه است.

ادعاي خودآگاه بودن LaMDA هم از طرف گوگل و هم از سمت متخصصان حوزهي هوش مصنوعي قويا رد شده است. راستش تكنولوژي هوش مصنوعي هنوز تا رسيدن به سيستمهاي خودآگاه فاصلهي زيادي دارد؛ فاصلهاي كه به اعتقاد بسياري از متخصص كارشناسان، به ۵۰ سال ميرسد.

PaLM

PaLM مخفف Pathways Language Model مدل زباني ديگري از گوگل است كه بهمراتب از لمدا پيچيدهتر است.

گوگل PaLM را در رويداد I/O 2022 همزمان با معرفي LaMDA 2 رونمايي كرد كه بهتازگي در دسترس توسعهدهندگان قرار گرفته است. اين مدل ميتواند ازپسِ كارهايي برآيد كه LaMDA نميتواند انجامشان دهد؛ كارهايي مثل حل مسائل رياضي، كدنويسي، ترجمهي زبان برنامهنويسي C به پايتون، خلاصهنويسي متن و توضيحدادن لطيفه. موردي كه حتي خود توسعهدهندگان را نيز غافلگير كرد، اين بود كه PaLM ميتواند استدلال كند يا دقيقتر بگوييم PaLM ميتواند فرايند استدلال را اجرا كند.

PaLM به ۵۴۰ ميليارد پارامتر مجهز است كه از LaMDA چهار برابر و از مدل زباني GPT-3 بهكار رفته در ChatGPT، سه برابر بيشتر است. PaLM بهدليل بهرهمندي از چنين مجموعهي گستردهاي از پارامتر، ميتواند صدها كار مختلف را بدون نياز به يادگيري انجام دهد و شايد عدهاي حتي وسوسه شوند كه اين مدل را نزديكترين دستاورد بشر به «هوش مصنوعي قوي» بدانند، چون ميتواند هر كار مبتنيبر تفكري را كه انسان ميتواند انجامش دهد، بدون يادگيري خاصي انجام دهد.

خطرات هوش مصنوعي

هوش مصنوعي شبيه شخصيتهاي خاكستري داستانها، نه صددرصد پليد است و نه صددرصد فرشتهي نجات و ابرقهرمان. در همان حال كه زندگي بشر را سادهتر و تكنولوژيهاي پيچيده و گرانارزش را دردسترستر ميكند، ميتواند خطرات و چالشهايي نيز به دنبال داشته باشد كه در ادامه به برخي از آنها اشاره ميكنيم:

از بين رفتن برخي مشاغل بهخاطر اتوماسيون؛ از سال ۲۰۰۰ تاكنون، هوش مصنوعي و سيستمهاي اتوماسيون ۱٫۷ ميليون شغل در حوزهي توليد را كنار گذاشتهاند. باتوجه به «گزارش ۲۰۲۰ آيندهي مشاغل» مجمع جهاني اقتصاد، انتظار ميرود تا سال ۲۰۲۵، هوش مصنوعي جاي ۸۵ ميليون شغل در سراسر جهان را بگيرد. مشاغلي مثل تجزيهوتحليل داده، تلهماركتينگ و خدمات مشتري، كدنويسي، حملونقل و خردهفروشي در خطر جايگزيني كامل با هوش مصنوعي هستند.

دستكاري اجتماعي از طريق الگوريتمها؛ هوش مصنوعي ميتواند از طريق پلتفرمهاي الكترونيك نظير شبكههاي اجتماعي، رسانههاي خبري و حتي فروشگاههاي الكترونيك، هم انديشي ها، رفتارها و احساسات افراد را تحتتاثير قرار دهد. هوش مصنوعي همچنين ميتواند با توليد محتواي جعلي يا گمراهكننده مثل ويديوهاي ديپفيك، به افراد آسيب برساند.

نظارت اجتماعي با هوش مصنوعي؛ دولتها و شركتها بهكمك فناوري تشخيص چهره، رديابي مكان و دادهكاوي كه همگي مبتنيبر هوش مصنوعي است، ميتوانند به نظارت گسترده از شهروندان و متخصصان بپردازند. اين موضوع، حريم خصوصي، امنيت و آزاديهاي مدني افراد را تهديد ميكند.

تعصبات ناشي از هوش مصنوعي؛ هوش مصنوعي ميتواند تعصبات انساني را در دادهها يا طراحي خود به ارث برده يا تقويت كند. اين تعصبات ميتواند منجر به نتايج ناعادلانه يا تبعيضآميز براي گروههاي خاصي از مردم از انديشه متخصصين نژادي، جنسيت، سن و غيره شود.

گسترش نابرابري اجتماعياقتصادي؛ هوش مصنوعي ميتواند بين افرادي كه به مزاياي آن دسترسي دارند و افرادي كه از آنها بيبهرهاند، شكاف ديجيتالي ايجاد كند. هوش مصنوعي همچنين ميتواند شكاف بين افراد ثروتمند و فقير را با تمركز ثروت و قدرت در دست عدهاي كه كنترل سيستمهاي هوش مصنوعي را بهعهده دارند، افزايش دهد.

جنگافزارهاي خودمختار؛ هوش مصنوعي ميتواند در توسعهي سلاحهاي مرگبار خودمختاري بهكار ميرود كه به اهداف بدون دخالت انسان شليك كنند. درحاليكه عدهاي ميگويند با جايگزين كردن سربازهاي انسان با رباتها، آمار تلفات كشور دارندهي اين سلاحها كم ميشود، در اختيار داشتن ارتشي كه تلفات جاني روي دست كشور پيشرفتهتر نميگذارد، انگيزهي بيشتري به آن كشور براي آغاز جنگ ميدهد.

آينده هوش مصنوعي

تا چند سال پيش، آيندهي هوش مصنوعي، همين چتباتها و مولدهاي تصويري چون ChatGPT و Midjourney بود كه چند وقتي است در دسترس عموم قرار گرفتهاند و قرار است تا چند سال ديگر، به بهبودهاي چشمگيري دست پيدا كنند. براي مثال، شركت OpenAI در حال كار روي نسخهي چهارم مدل زباني بزرگ GPT است كه بهادعاي افراد سيليكونولي، قرار است در دنياي چتباتها معجزه كند. زماني، تصور اينكه دو نفر با دو زبان متفاوت بتوانند با هم صحبت كنند و همزمان حرف يكديگر را بفهمند تنها در داستانهاي علميتخيلي و بازيهاي Mass Effect ممكن بود؛ اما بعيد نيست تا چند وقت ديگر هوش مصنوعي چنين تصوري را به واقعيت تبديل كند.

اينطور كه پيدا است، هوش مصنوعي، مهمترين تكنولوژي آينده است و سناريوهاي زيادي براي پيشرفت آن تعريف شدهاند؛ ازجمله:

هوش مصنوعي بيشتر با هوش انساني ادغام ميشود و تواناييهاي ما را افزايش ميدهد؛ مثلا رابطهاي مغز و كامپيوتر، پردازش زبان طبيعي و بينايي ماشين ميتوانند ارتباطات، يادگيري و ادراك ما را تقويت كنند.

هدف نهايي تمام پروژههاي هوش مصنوعي رسيدن به AGI است

هوش مصنوعي خودمختارتر و با محيطهاي پيچيده سازگارتر ميشود؛ مثلا خودروهاي خودران، خانههاي هوشمند و دستيارهاي رباتيك ميتوانند با حداقل نظارت يا دخالت انسان كار كنند.

هوش مصنوعي در توليد محتوا يا ارائهي راهحلهاي جديد، خلاقانهتر خواهد شد؛ مثلا شبكههاي مولد رقابتي، الگوريتمها و توليد زبان طبيعي ميتوانند تصاوير، آثار هنري، موسيقي يا متن واقعگرايانهاي توليد كنند.

هوش مصنوعي با عوامل ديگر، چه انساني چه ماشيني، وارد همكاري بيشتري ميشود. مثلا، سيستمهاي چندعاملي (MAS)، هوش گروهي (swarm intelligence) و يادگيري تقويتي ميتوانند تصميمگيري، حل مسئله و هماهنگيهاي جمعي را ممكن كنند.

و البته هوش مصنوعي در مباحثه منابع داده، اصول طراحي، متخصصدها و تاثيراتش متنوعتر و جامعتر خواهد شد. مثلا ميتوان به پيشرفتهايي در هوش مصنوعي مسئولانه، هوش مصنوعي دروننما (explainable AI) كه درون الگوهاي پيچيدهي يادگيري هوشمند را براي انسانها آشكار ميكند و هوش مصنوعي منصفانه و هوش مصنوعي قابلاعتماد، اشاره كرد.

اما هدف نهايي تمام افرادي كه در حوزهي هوش مصنوعي كار ميكنند، رسيدن به هوش مصنوعي قوي يا همان ماشيني است كه بتواند در تمام فعاليتها از قابليتهاي فكري انسان جلو بزند. يعني چيزي شبيه همان رباتهاي خودآگاهي كه در فيلمها ميبينيم. البته تا رسيدن به چنين سطحي از هوش مصنوعي زمان زيادي باقي مانده؛ اگر انديشه متخصصين متخصصان OpenAI را بپرسيد، به شما خواهند گفت تا ۱۳ سال آينده به هوش مصنوعي قوي ميرسند، اما اكثر متخصصان اين حوزه روي ۵۰ سال شرط بستهاند.

آيا هوش مصنوعي بشر را نابود ميكند؟

خب با تمام اين حرفها و پيشرفتهاي چشمگيري كه در حوزه هوش مصنوعي صورت گرفته، آيا بايد تا چند وقت ديگر انتظار ظهور رباتهاي قاتل مثل اسكاينت در فيلمهاي ترميناتور يا هال ۹۰۰۰ در فيلم اديسه فضايي را داشته باشيم؟

اگر اهل تماشاي مستندهاي حياتوحش باشيد، احتمالا به اين موضوع دقت كردهايد كه در پايان تمام آنها، افرادي هستند كه دربارهي اينكه چطور اين همه زيبايي باشكوه قرار است به زودي بهدست انسانها نابود شود، صحبت ميكنند. به همينخاطر هم فكر ميكنم هر مباحثه مسئولانهاي كه دربارهي هوش مصنوعي صورت ميگيرد، بايد در مورد محدوديتها و پيامدهاي اجتماعي آن نيز صحبت كند.

موفقيت هوش مصنوعي بهشدت به مدلهايي بستگي دارد كه براي يادگيري آنها انتخاب ميكنيم

ابتدا بياييد بار ديگر بر محدوديتهاي كنوني هوش مصنوعي تاكيد كنيم؛ اگر فقط يك نكته باشد كه اميدوارم از خواندن اين مطلب به آن رسيده باشيد، اين است كه موفقيت يادگيري ماشين يا هوش مصنوعي بهشدت به مدلهايي بستگي دارد كه ما براي يادگيري آنها انتخاب ميكنيم. اگر انسانها اين شبكهها را بدون رعايت استانداردها و اصول اوليه بسازند يا از دادههاي اشتباه و گمراهكننده براي يادگيري هوش مصنوعي استفاده كنند، آنوقت اين اشكالات ميتواند تاثيرات ناگواري بههمراه داشته باشند.

شبكههاي عصبي عميق بسيار انعطافپذير و قدرتمند هستند، اما معجزه و جادويي نيستند. باوجود اينكه ممكن است از شبكههاي عصبي عميق هم براي RNN و هم CNN استفاده كرد، بايد توجه داشت كه ساختار زيربنايي اين دو شبكه بسيار متفاوت است و تا اينلحظه نياز بوده كه انسانها آنها را از پيش تعريف كنند. بنابراين، اگرچه ميتوان CNNاي را كه براي تشخيص خودرو يادگيري ديده، براي تشخيص پرندگان از نو يادگيري داد، اما نميتوان اين مدل را براي درك گفتار به كار برد.

بهعبارت سادهتر، مثل اين است كه ما متوجه شدهايم كه قشر بينايي و قشر شنوايي چطور كار ميكنند، اما مطلقا هيچ ايدهاي نداريم كه قشر مغز چطور كار ميكند و اينكه اصلا براي فهم آن بايد از كجا شروع كرد. و اين يعني ما احتمالا به اين زوديها به هوش مصنوعي انسانگونه به سبك فيلمهاي هاليوودي دست نخواهيم يافت. البته اين به اين معني نيست كه هوش مصنوعي فعلي نميتواند تاثيرات اجتماعي منفي بهدنبال داشته باشد. براي همين، آشنايي با مفاهيم اوليهي هوش مصنوعي شايد حداقل كاري باشد كه بتوان براي پيدا كردن راهي براي حل اشكالات هوش مصنوعي (و جلوگيري از نابودي زمين!) انجام داد.

هم انديشي ها