چرا فريب دادن سيستمهاي هوش مصنوعي مبتني بر يادگيري عميق بسيار آسان است

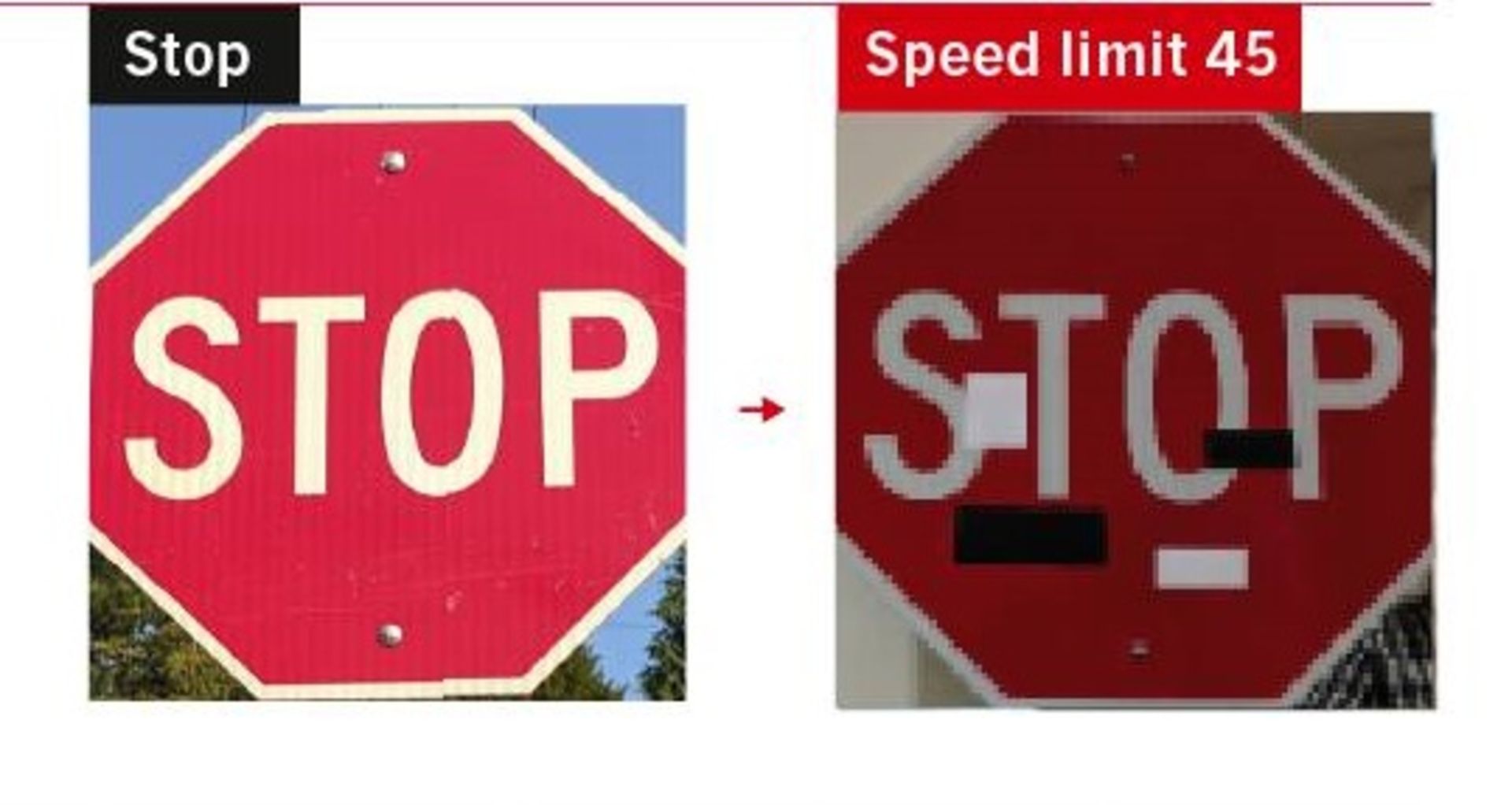

اتومبيل خودراني به يك علامت توقف نزديك ميشود اما بهجاي اينكه از سرعت خود كم كند، با سرعت زياد وارد تقاطع شلوغ ميشود. بعدا، گزارش تصادف نشان ميدهد كه چهار مستطيل كوچك روي علامت توقف چسبيده بود و موجب شد كه سيستم هوش مصنوعي اتومبيل، كلمهي توقف را با علامت حداكثر سرعت مجاز ۴۵ كيلومتر اشتباه بگيرد. اگرچه چنين رويدادي درواقعيت اتفاق نيفتاده، اما پتانسيل خرابكاري هوش مصنوعي كاملا واقعي است.

پژوهشگران قبلا نشان دادهاند كه وقتي برچسبهايي روي برخي از قسمتهاي تابلوي توقف چسبانده شود، سيستم هوش مصنوعي بهراحتي فريب ميخورد. آنها سيستمهاي تشخيص چهره را نيز با چسباندن الگوهاي چاپي روي عينك يا كلاه فريب دادند. آنها همچنين با واردكردن الگوهاي صداي سفيد موجب شدند كه سيستم هوش مصنوعي تشخيص گفتار، عبارتهاي خيالي بشنود. اين موارد تنها چند مثال است كه نشان ميدهد شكستن تكنولوژي تشخيص الگو در هوش مصنوعي كه با عنوان «شبكههاي عصبي عميق» شناخته ميشوند، چقدر ساده است. اين سيستمها در طبقهبندي صحيح انواع وروديهاي مختلف شامل تصاوير، گفتار و دادههاي مربوط به اولويتهاي خريداران بسيار موفق عمل كردهاند. آنها بخشي از زندگي روزمرهي ما هستند و هرچيزي، از سيستمهاي تلفن خودكار گرفته تا توصيههاي متخصصان را روي سرويس سيال نتفليكس اجرا ميكنند. با اين حال، ايجاد تغيير در وروديها (به شكل تغييرات ناچيزي كه معمولا براي انسان غيرمحسوس است) ميتواند بهترين شبكههاي عصبي موجود را هم گيج كند.

دن هندريكس، دانشجوي دكتري علوم كامپيوتر دانشگاه كاليفرنيا نيز مانند بسياري از دانشمندان، شبكههاي عصبي عميق را اساسا شكننده تصور ميكند: اين شبكهها تا زمانيكه به قلمرو ناشناختهها وارد نشوند، عملكرد درخشاني دارند اما وقتي در شرايط غيرمنتظرهاي قرار ميگيرند، بهشدت شكننده هستند. اين امر ميتواند منجر به بروز اشكالات قابلتوجهي شود. سيستمهاي يادگيري عميق در حال خارج شدن از آزمايشگاه و وارد شدن به جهان واقعي هستند. اين سيستمها در حوزههاي مختلفي مانند هدايت اتومبيلهاي خودران، نقشهيابي جرم و تشخيص بيماريها مورد استفاده قرار ميگيرند اما نتايج مطالعهاي كه امسال منتشر شد، نشان ميداد كه افزودن چند پيكسل به اسكنهاي پزشكي موجب ميشود كه اين سيستمها در تشخيص سرطان اشتباه عمل كنند. برخي متخصص كارشناسان هم ميگويند يك هكر ميتواند از نقاط ضعف سيستم استفاده كرده و الگوريتمهاي مهاجم خود را روي آن اجرا كند. پژوهشگران در تلاش براي پي بردن به اشتباهات ممكن، اطلاعات زيادي درمورد علت ناكامي شبكههاي عصبي عميق به دست آوردهاند. فرانسوا چوليت، مهندس هوش مصنوعي گوگل در مانتين ويو ميگويد:

راهحلي براي ضعفهاي اساسي شبكههاي عصبي عميق وجود ندارد.

او و برخي ديگر از متخصص كارشناسان معتقدند كه براي برطرف كردن اين نقايص لازم است قابليتهاي ديگري نيز به اين شبكهها افزوده شود؛ براي مثال، سيستمهاي هوش مصنوعي طراحي شود كه خود بتوانند جهان را كشف كنند، كدهاي خود را بنويسند و خاطرات را حفظ كنند. برخي از متخصص كارشناسان بر اين باورند كه اين نوع سيستمها موضوع پژوهشهاي هوش مصنوعي دههي آينده هستند.

مطالعه واقعيت

در سال ۲۰۱۱، گوگل سيستمي را ارائه داد كه ميتوانست گربههاي موجود در ويدئوهاي يوتيوب را تشخيص دهد و بالافاصله پس از آن، موجي از سيستمهاي طبقهبندي مبتني بر شبكههاي عصبي عميق ارائه شد. جف كلون از دانشگاه وايومينگ ميگويد:

همه ميگفتند اين سيستم چقدر شگفتانگيز است، كامپيوترها سرانجام ميتوانند جهان را درك كنند.

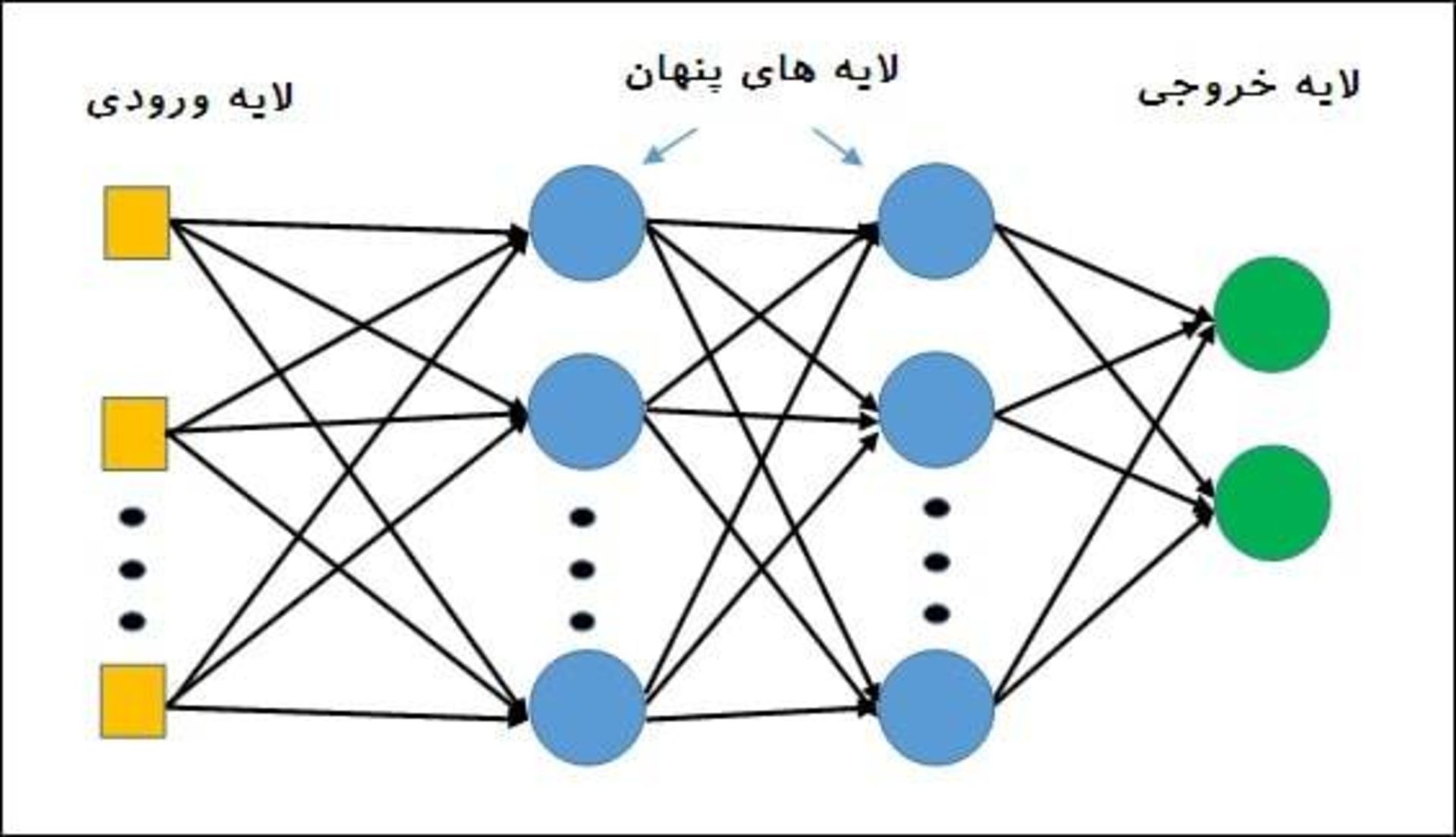

اما پژوهشگران هوش مصنوعي ميدانستند كه شبكههاي عصبي عميق درواقع جهان را نميفهمند. اين ساختارهاي نرمافزاري كه تقليدي ساده از معماري مغز هستند، از تعداد زيادي نورون ديجيتالي ساخته شدهاند كه در لايههاي زيادي مرتب شدهاند. هر نورون به نورونهاي لايههاي بالا و پايين خود وصل ميشود. ايده اين است كه ويژگيهاي ورودي خام كه وارد لايههاي زيرين ميشود (مانند پيكسلهاي يك تصوير) موجب برانگيختگي برخي از نورونها ميشود و سپس اين نورونها طبق قوانين سادهي رياضي، سيگنالي را به نورونهاي موجود در لايهي بالايي منتقل ميكنند.

براي يادگيري يك شبكهي شبكههاي عصبي عميق، آن را در معرض مجموعهي عظيمي از مثالهاي مختلف قرار ميدهند. طي فرايند يادگيري، هر بار، روش اتصال نورونها به هم تغيير ميكند تا درنهايت پاسخ مورد انديشه متخصصين در لايهي بالايي ايجاد شود، طوري كه تصوير يك شير هميشه بهعنوان يك شير تفسير شود؛ حتي اگر قبل از آن، اين تصوير به سيستم ارائه نشده باشد.

اولين مطالعه مهم در ارتباط با اين مسئله در سال ۲۰۱۳ انجام شد، زمانيكه كريستين سزگدي و همكارانش گزارش مقدماتي را با عنوان «ويژگيهاي عجيب شبكههاي عصبي» منتشر كردند. اين پژوهشگران نشان دادند كه ميتوان مثلا تصويري از يك شير گرفت كه سيستم هوش مصنوعي آن را بشناسد و سپس با تغيير چند پيكسل ماشين را متقاعد كرد كه در حال ديدن چيز ديگري مانند يك جزوه رايگانخانه است. پژوهشگران اين تصاوير را «مثالهاي خصمانه» ناميدند. يك سال بعد، كلون و آنه نيگوين بههمراه جيسون يوسينسكي در دانشگاه كرنل نشان دادند كه ميتوان كاري كرد كه شبكههاي عصبي عميق چيزهايي را ببينند كه در آنجا وجود ندارند (مانند پنگوئني در الگويي از خطوط مواج). يوشوا بنگيو از دانشگاه مونترال، يكي از پيشگامان يادگيري عميق است. او ميگويد:

هركسي كه با يادگيري ماشين كار كرده باشد، ميداند كه اين سيستمها گاهي اشتباهات احمقانهاي ميكنند... چيزي كه عجيب بود، نوع اشتباه بود. اين نوعي اشتباه است كه تصور نميكرديم، پيش آيد.

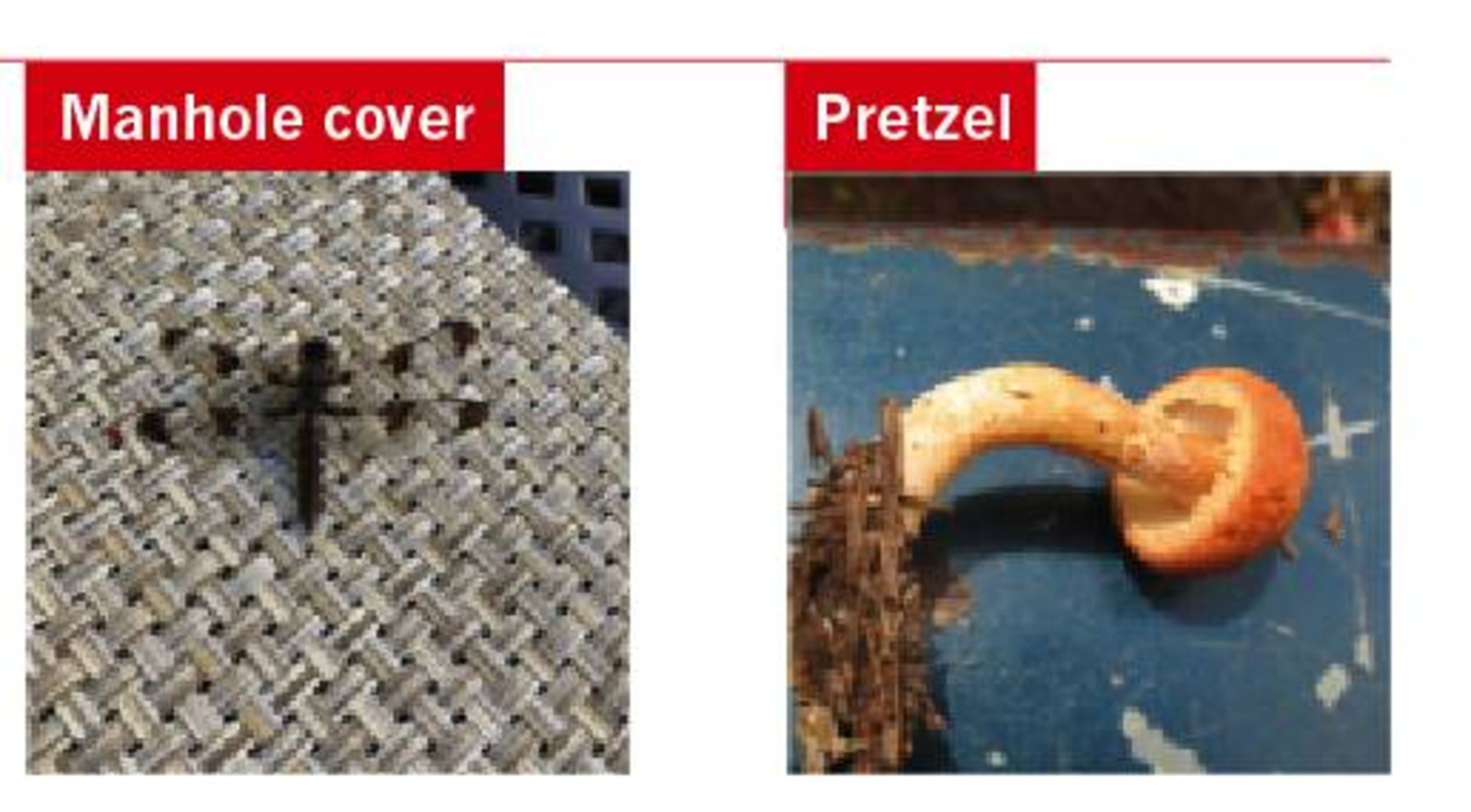

حتي تصاوير طبيعي ميتواند موجب فريب شبكههاي عصبي عميق شود زيرا ممكن است شبكه بهجاي انتخاب ويژگيهاي برجستهاي كه انسان قادر به تشخيص آن است، روي رنگ، بافت يا پسزمينهي تصوير تمركز كند.

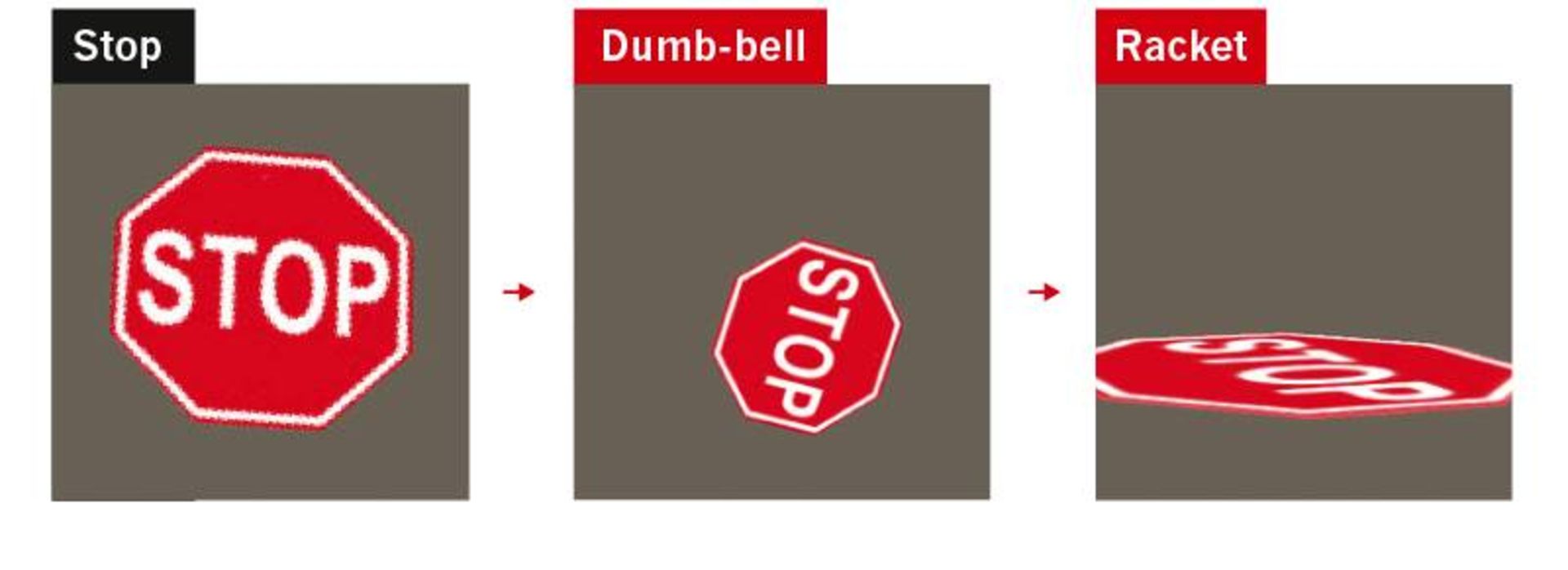

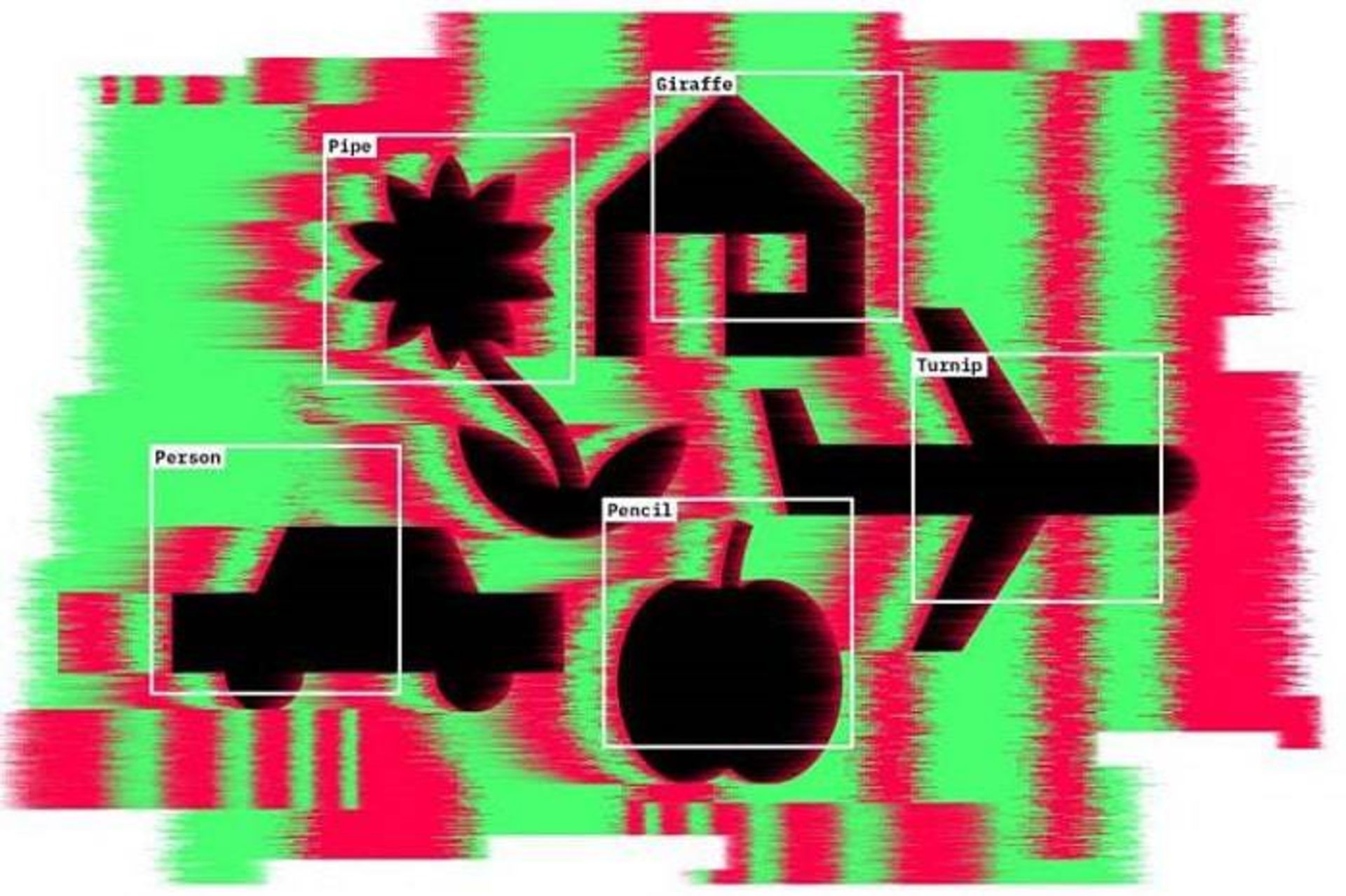

پژوهشگران انواع مختلفي از اشتباهاتي را كه در اين سيستمها پيش ميآيد، نشان دادهاند. سال گذشته، نيگوين نشان داد كه برخي از بهترين سيستمهاي طبقهبندي تصاوير، حتي با چرخش سادهي اشياء دچار اشتباه ميشوند. امسال، هندريكس و همكارانش گزارش كردند كه حتي تصاوير طبيعي ميتوانند موجب به اشتباه افتادن سيستمهاي پيشرفتهي طبقهبندي شود. در مثالهاي آنها، سيستم اشتباها يك قارچ را بهعنوان پرتزل (نوعي نان پختهشده به شكل گره) يا يك سنجاقك را بهعنوان يك دريچهي منهول شناسايي ميكرد.

اين نوع اشتباهات مختص تشخيص اشياء نيست: هر سيستم هوش مصنوعي كه براي طبقهبندي وروديهايي مانند گفتار از شبكههاي عصبي عميق استفاده ميكند، ممكن است فريب بخورد. سيستمهاي هوش مصنوعي كه بازي ميكنند نيز ميتوانند خرابكاري كنند: در سال ۲۰۱۷، سندي هوآنگ، دانشجوي دكتري دانشگاه كاليفرنيا به اتفاق همكارانش شبكههاي عصبي عميقي را كه به روش يادگيري تقويتي يادگيري ديده بودند تا بازيهاي ويدئويي آتاري را ببرند، مورد مطالعه قرار دادند. در اين رويكرد، براي هوش مصنوعي يك هدف تعريف ميشود و سيستم در پاسخ به طيف وسيعي از وروديها و ازطريق آزمون و خطا ياد ميگيرد كه براي رسيدن به آن هدف بايد چه كاري انجام دهد. اين همان تكنولوژي پشتصحنهي قهرمانان برنامههايي مانند آلفازيرو و ربات پوكر پلوريبوس است. با اين حال، گروه هوآنگ توانست با افزودن يكي دو پيكسل تصادفي به صحنه موجب شكست بازيهاي هوش مصنوعي شود.

اوايل سال جاري، آدام گليو، دانشجوي دكتري هوش مصنوعي در دانشگاه كاليفرنيا نشان داد كه ميتوان عاملي را به محيط هوش مصنوعي وارد كرد كه براي ايجاد سردرگمي در پاسخهاي هوش مصنوعي، سياستهاي خصمانهاي را اجرا كند. براي مثال، يك فوتباليست هوش مصنوعي كه يادگيري ديده است در محيط شبيهسازي شده توپ را از اطراف دروازهبان عبور دهد، وقتي كه دروازهبان رفتار غيرمنتظرهاي مانند افتادن روي زمين را از خود نشان ميدهد، توانايي گلزني خود را از دست ميدهد.

يك فوتباليست هوش مصنوعي در محيط شبيهسازيشده، هنگام زدن ضربات پنالتي، وقتي كه دروازهبان رفتار پيشبينينشدهاي مانند افتادن روي كف زمين را از خود نشان ميدهد، گيج ميشود

آگاهي از نقاط ضعف شبكههاي عصبي عميق موجب ميشود هكر بتواند بر هوش مصنوعي تسلط پيدا كند. سال گذشته گروهي از پژوهشگران گوگل نشان دادند كه استفاده از مثالهاي خصمانه نهتنها موجب ميشود كه شبكههاي عصبي عميق اشتباه كنند، بلكه اين كار ميتواند حتي موجب برنامهريزي مجدد و تعيين اهداف ديگري براي سيستم شود.

بسياري از شبكههاي عصبي مانند سيستمهايي كه درك زبان را ياد ميگيرند، ميتوانند براي رمزگذاري ديگر برنامههاي كامپيوتري مورد استفاد قرار گيرند. كلون ميگويد ازانديشه متخصصين تئوري، شما ميتوانيد يك چتبات را به هر برنامهاي كه ميخواهيد تبديل كنيد. او وضعيتي را در آيندهي نزديك تصور ميكند كه در آن هكرها شبكههاي عصبي را ربوده و الگوريتمهاي اسپمبوت خود را اجرا ميكنند. ازانديشه متخصصين داون سونگ، دانشمند كامپيوتر دانشگاه كاليفرنيا، شبكههاي عصبي عميق بسيار آسيبپذير هستند. او ميگويد روشهاي بسيار مختلفي براي حمله به يك سيستم وجود دارد و دفاع دربرابر آنها بسيار دشوار است.

چرخاندن اشياء موجود در يك تصوير موجب گيج شدن شبكهي عصبي عميق ميشود، احتمالا به اين علت كه اين تصويرها از تصاويري كه براي يادگيري شبكه مورد استفاده قرار گرفته است، بسيار متفاوت هستند

شبكههاي عصبي عميق قدرتمندند زيرا داشتن لايههاي زياد به اين معنا است كه آنها در هنگام تلاش براي طبقهبندي يك ورودي ميتوانند الگوها را براساس ويژگيهاي بسيار مختلفي انتخاب كنند. يك سيستم هوش مصنوعي يادگيريديده براي شناسايي هواگرد ممكن است فكر كند، ويژگيهايي از قبيل لكههاي رنگ، بافت يا پسزمينه درست به اندازهي خصوصياتي مانند بالها، پيشبينيكنندههاي قدرتمندي هستند. اما اين امر همچنين بدين معنا است كه تغيير بسيار كوچكي در ورودي ميتواند باعث شود سيستم هوش مصنوعي آن شي را به شكل متفاوتي درك كند.

يك راهحل ممكن اين است كه دادههاي بيشتري در اختيار هوش مصنوعي قرار داده شود، بهخصوص بهمنظور مواجههي مكرر هوش مصنوعي با موارد اشكالساز و تصحيح خطاهاي آن. در اين شكل از يادگيري، همانطور كه يك شبكه ياد ميگيرد اشياء را شناسايي كند، سيستم دوم سعي ميكند وروديهاي شبكهي اول را بهگونهاي تغيير دهد كه موجب اشتباه شود. به اين ترتيب، مثالهاي خصمانه بخشي از دادههاي يادگيريي شبكههاي عصبي عميق ميشوند.

هندريكس و همكارانش پيشنهاد كردهاند كه بايد قاطعيت شبكههاي عصبي عميق دربرابر ايجاد خطا، با آزمون چگونگي عملكرد آنها دربرابر طيف وسيعي از مثالهاي خصمانه مورد آزمايش قرار گيرد. اگرچه بهعقيدهي اين دانشمندان، يادگيري شبكه براي ايجاد مقاومت دربرابر يك نوع حمله ميتواند آن را در برابر ديگر حملات تضعيف كند.

پژوهشگراني تحت هدايت پوشميت كوهلي در ديپمايند گوگل درحال تلاش براي مقاوم كردن شبكههاي عصبي عميق دربرابر اشتباهات هستند. بسياري از حملات خصمانه با ايجاد تغييرات جزئي در اجزاي يك ورودي عمل ميكنند (مانند تغيير ظريف در رنگ پيكسلهاي يك تصوير). آنها اين تغييرات را تا زمانيكه موجب هدايت شبكه بهسوي طبقهبندي اشتباه شود، ادامه ميدهند. گروه كوهلي ميگويد كه يك شبكهي عصبي قاطع نبايد خروجي خود را به خاطر تغييرات جزئي در ورودي تغيير دهد و شايد بهتر باشد اين ويژگي ازانديشه متخصصين رياضي در شبكه گنجانده شده و چگونگي يادگيري آن را محدود كند.

البته در حال حاضر كسي راهحلي براي برطرف كردن اشكال كلي شكنندگي سيستمهاي هوش مصنوعي ندارد. بنگيو ميگويد ريشهي اين مسئله آن است كه شبكههاي عصبي عميق، مدل خوبي براي چگونگي انتخاب ويژگيهاي مهم ندارند. هنگامي كه يك هوش مصنوعي تصوير مستندي از يك شير را بهعنوان يك جزوه رايگانخانه ميبيند، يك انسان آن را هنوز يك شير ميبيند زيرا او داراي يك مدل ذهني از حيوان بوده كه اين مدل ذهني مبتني بر مجموعهاي از ويژگيهاي رده بالا است (گوشها، دم، يال و غيره) كه به او اجازه ميدهد كه آن را از ويژگيهاي رده پايين يا جزئيات تصادفي جدا كند. بنگيو ميگويد:

ما از تجارب گذشته ميدانيم كه كدام ويژگيها مهم هستند و اين از درك عميق ما درمورد ساختار جهان حاصل ميشود.

يك روش براي پرداختن به اين مسئله، تركيب شبكههاي عصبي عميق با هوش مصنوعي سمبليك است كه قبل از يادگيري ماشين، مدل غالب در اين زمينه بود. بهكمك هوش مصنوعي سمبليك، ماشينها با استفاده از قوانين كدنويسي سخت درمورد چگونگي كار جهان استدلال ميكنند؛ مانند اينكه اين جهان، حاوي اشياء گسستهاي است كه به طرق مختلفي با هم در ارتباط هستند.

برخي از پژوهشگران مانند گري ماركوس، روانشناس دانشگاه نيويورك ميگويد كه مدلهاي هوش مصنوعي هيبريدي راهحل اين اشكال هستند. ماركوس ميگويد :

يادگيري عميق در كوتاهمدت بهقدري مفيد است كه مردم بينش بلندمدت خود را درمورد آن از دست دادهاند.

در ماه مه، او همبنيانگذار استارتاپي به نام Robust AI در كاليفرنيا بود كه هدف آن تلفيق يادگيري عميق با تكنيكهاي هوش مصنوعي مبتني بر قانون بود. آنها قصد داشتند رباتهايي بسازند كه بتوانند بهطور بيخطر در كنار مردم كار كنند. البته كاري كه دقيقا اين شركت در حال انجام آن است، مشخص نيست.

حتي اگر بتوان قوانيني را در شبكههاي عصبي عميق تعبيه كرد، عملكرد آنها وابسته به اطلاعاتي است كه براساس آنها يادگيري ميبينند. بنگيو ميگويد كه عوامل هوش مصنوعي بايد در محيطهاي غنيتري يادگيري ببينند. براي مثال، بيشتر سيستمهايي بينايي كامپيوتر در تشخيص قوطي نوشيدني كه حالت استوانهاي دارد، شكست ميخورند؛ زيرا آنها براساس مجموعه دادههاي دوبعدي يادگيري ديده بودند. نيگوين و همكارانش نيز متوجه شدند كه فريب دادن اين شبكهها از طريق نشان دادن اشياء آشنا از نماهاي مختلف آسان است. براين اساس، يادگيري در يك محيط سهبعدي (واقعي يا شبيهسازيشده) بهتر است.

نحوهي يادگيري هوش مصنوعي نيز بايد تغيير كند. بنگيو ميگويد:

يادگيري درمورد عليت بايد بهوسيلهي عواملي انجام شود كه در جهان واقعي كار ميكنند و ميتوانند آزمايش و اكتشاف كنند.

يورگن اشميدوبر از مؤسسهي پژوهشهاي هوش مصنوعي دال مول در مانو نيز در همين راستا ميانديشد. او ميگويد تشخيص الگو بسيار قدرتمند است و به آن اندازه خوب است كه ارزش بسيار زيادي به شركتهاي جهاني مانند علي بابا، تنسنت، آمازون، فيسبوك و گوگل ميبخشد. اما موج بسيار بزرگتري در حال رسيدن است: ماشينهايي كه جهان را دستكاري ميكنند و با اعمال خود، دادههايي را توليد ميكنند. درواقع، سيستمهاي هوشهاي مصنوعي كه از يادگيري تقويتي براي برد در بازيهاي كامپيوتري استفاده ميكنند، در حال انجام چنين كاري در محيطهاي مصنوعي هستند: آنها براي رسيدن به هدف و با آزمون و خطا، به روشهاي مجاز، پيكسلهاي روي صفحهي نمايش را دستكاري ميكنند. اما محيطهاي واقعي بسيار غنيتر از مجموعه دادههاي شبيهسازيشده يا دادههاي سازماندهيشدهاي است كه امروزه بيشتر شبكههاي عصبي عميق با استفاده از آنها يادگيري ميبينند.

رباتهايي كه ابتكار عمل دارند

در آزمايشگاهي در دانشگاه كاليفرنيا يك بازوي رباتيك در ميان اشياء درهم به جستوجو مشغول است. او يك كاسهي قرمز را برميدارد و با استفاده از آن يك دستكش آبي را چند سانتيمتر به سمت راست هل ميدهد. او كاسه را مياندازد و يك بطري پلاستيكي خالي را برميدارد. سپس شكل و وزن يك جزوه رايگان را مطالعه ميكند. طي چندين روز مكاشفهي بدون وقفه، ربات درمورد اين اشياء بيگانه و كاري كه با استفاده از آنها ميتواند انجام دهد، حسي به دست ميآورد. اين بازوي رباتيك در حال استفاده از يادگيري عميق درجهت يادگيري استفاده از ابزار است. وقتي جعبهاي از اشياء در اختيار او قرار داده ميشود، او آنها را به نوبت برداشته و به آنها نگاه ميكند، او ميبيند كه وقتي اشياء را تكان ميدهد و آنها را به هم ميكوبد، چه اتفاقي ميافتد.

رباتهايي كه از يادگيري عميق براي اكتشاف نحوهي استفاده از ابزارهاي سهبعدي استفاه ميكنند

هنگامي كه پژوهشگران هدفي را براي ربات مشخص ميكنند (براي مثال به او تصويري از يك جعبهي تقريبا خالي نشان ميدهند تا او اشياء را به آن شكل مرتب كند)، ربات ابتكار عمل به خرج داده و ميتواند با اجسامي كار كند كه قبلا اصلا آنها را نديده است. او ميتواند از يك اسنفج براي كنار زدن اشياء استفاده كند. او همچنين دريافته است كه استفاده از يك بطري براي ضربه زدن و كنار زدن اشياء موجود در مسير بهتر از برداشتن مستقيم آنها است. چلسي فين كه قبلا در آزمايشگاه بركلي كار ميكرد و اكنون در حال ادامهي پژوهش خود در دانشگاه استنفورد است، ميگويد اين نوع يادگيري، درك بسيار غنيتري از اشياء و جهان در اختيار هوش مصنوعي قرار ميدهد. اگر شما يك بطري آب يا اسنفج را فقط در تصاوير ميديديد، شايد ميتوانستند آنها را در تصاوير ديگر نيز تشخيص دهيد اما واقعا نميتوانستيد درك كنيد كه آنها چه چيزي هستند يا براي چه كاري ميتوان از آنها استفاده كرد. او ميگويد:

در اين حالت درك شما از جهان بسيار سطحيتر خواهد بود، نسبتبه حالتي كه ميتوانستيد واقعا با آنها تعامل برقرار كنيد.

اما اين روش يادگيري، فرايند كندي است. در يك محيط شبيهسازيشده، يك سيستم هوش مصنوعي ميتواند با سرعت زيادي مثالهاي مختلف را مطالعه و درك كند. در سال ۲۰۱۷، آلفازيرو، طي يك روز يادگيري ديد تا در بازيهاي گو، شطرنج و شوگي (نوعي شطرنج ژاپني) پيروز شود. او براي هر رويداد بيش از ۲۰ ميليون بازي يادگيريي انجام داد.

رباتهاي هوش مصنوعي نميتوانند با اين سرعت يادگيري ببينند. جف ماهلر، همبنيانگذار شركت هوش مصنوعي و رباتيك آمبيدكستروس ميگويد، تقريبا تمام نتايج مهم يادگيري عميق متكي بر حجم زيادي از داده هستند. جمعآوري دهها ميليون داده نيازمند سالها اجرا روي يك ربات است. از اين گذشته، دادهها ممكن است چندان قابل اعتماد نباشند؛ زيرا تنظيم حسگرها طي زمان تغيير كرده و سختافزارها نيز ممكن است تخريب شوند. بههمين دليل، در بيشتر كارهاي رباتيكي كه شامل يادگيري عميق است، براي سرعت بخشيدن به روند يادگيري، هنوز از محيط هاي شبيهسازيشده استفاده ميشود. ديويد كنت، دانشجوي دكتري رباتيك مؤسسهي فناوري جورجيا در آتلانتا ميگويد:

آنچه شما ميتوانيد ياد بگيريد، به اين موضوع بستگي دارد كه شبيهسازها چقدر خوب هستند.

شبيهسازها همواره در حال پيشرفت بوده و پژوهشگران درزمينهي انتقال درسهاي آموختهشده در دنياهاي مجازي به دنياي واقعي در حال پيشرفت هستند؛ اگرچه چنين شبيهسازيهايي هنوز هم با پيچيدگيهاي موجود در جهان واقعي مطابقت ندارند. فين استدلال ميكند كه افزايش مقياس يادگيري با استفاده از رباتها، آسانتر از يادگيري با دادههاي مصنوعي است. ربات او كه در حال يادگيري استفاده از ابزار است، براي يادگيري يك وظيفهي نسبتا ساده به چندين روز زمان نياز دارد اما احتياجي به نظارت سنگين ندارد. او ميگويد:

شما ربات را اجرا ميكنيد و هر چند وقت يك بار آن را چك ميكنيد.

او روزي را تصور ميكند كه تعداد زيادي از اين رباتها در جهان واقعي بهطور مستقل و بدون وقفه در حال يادگيري هستند. بهعقيدهي او، اين كار بايد امكانپذير باشد، چرا كه انسانها نيز از همين طريق جهان را درك ميكنند. اشميدوبر ميگويد:

يك كودك ازطريق دانلود كردن اطلاعات از فيسبوك چيزي ياد نميگيرد.

يادگيري با استفاده از دادههاي كمتر

كودك ميتواند موارد جديد را از روي دادههاي كم تشخيص دهد: حتي اگر هرگز قبلا زرافه نديده باشد، پس از يكي دوبار ديدن، آن را ياد ميگيرد. علت اين سرعت يادگيري تاحدودي به اين موضوع مربوط ميشود كه اگرچه كودك زرافه نديده، اما موجودات زندهي ديگري را ديده و با ويژگيهاي متمايز آنها آشنا است. يك اصطلاح كامل براي اعطاي اين نوع قابليت به هوش مصنوعي، «يادگيري انتقالي» است: ايده انتقال دانش بهدستآمده از دورههاي قبلي يادگيري به وظيفهي بعدي. يك راه براي انجام اين كار، استفادهي مجدد از تمام يا بخشي از شبكهي قبلا يادگيريديده، بهعنوان نقطهي آغاز يادگيري براي يك وظيفهي جديد است. براي مثال، استفادهي مجدد از قسمتهايي از شبكههاي عصبي عميق كه قبلا براي شناسايي نوعي حيوان استفاده شده است (مثلا لايههايي كه شكل اصلي بدن را ميشناسند)، ميتواند هنگام يادگيري براي شناسايي يك زرافه اطلاعات مقدماتي مفيدي را در اختيار شبكه قرار دهد.

هدفِ يك شكل افراطي از يادگيري انتقالي، يادگيري يك شبكهي جديد ازطريق نشاندادن فقط چند مثال و گاهي تنها يك مورد است. اين روش كه با نام يادگيري يك مرحلهاي (one-shot) يا چند مرحلهاي (few-shot) معروف است، بهشدت متكي بر شبكههاي عصبي عميقي است كه از قبل يادگيري ديدهاند. تصور كنيد كه ميخواهيد يك سيستم تشخيص چهره بسازيد كه افراد را در يك پايگاه دادهي جنايي شناسايي كند. يك روش، استفاده از شبكهي عصبي عميقي است كه قبلا ميليونها چهره را ديده است (نه لاخبار تخصصيا آنهايي در پايگاه داده هستند)، بهطوري كه ايدهي خوبي از ويژگيهاي برجستهاي نظير شكل بيني و فك به دست آورده باشد. حال، وقتي كه شبكه به چهرهي جديدي نگاه ميكند، ميتواند ويژگيهاي مفيد آن تصوير را استخراج كرده و سپس اين ويژگيها را با خصوصيات تصاوير موجود در پايگاه داده مقايسه كند و شبيهترين مورد را پيدا كند. داشتن اين نوع حافظهي از پيش يادگيريديده به هوش مصنوعي كمك ميكند تا بدون نياز به ديدن الگوهاي زياد، نمونههاي جديد را تشخيص دهد. اين كار موجب افزايش سرعت يادگيري با رباتها ميشود.

اما چنين شبكههايي هنوز هم ممكن است در مواجهه با موضوعاتي كه از تجربهي آنها فاصلهي زيادي دارد، دچار اشكال شوند. هنوز قدرت تعميم چنين شبكههايي مشخص نيست. حتي موفقترين سيستمهاي هوش مصنوعي مانند آلفازيروي ديپمايند نيز محدوديتهايي دارند. الگوريتم آلفازيرو ميتواند يادگيري ببيند تا هم گو و هم شطرنج بازي كند اما نميتواند هر دو را بهصورت همزمان بازي كند. يادگيري مجدد ارتباطات و پاسخها، به گونهاي كه بتواند در بازي شطرنج برنده شود، موجب تنظيم مجدد هرگونه تجربهي قبلي درمورد بازي گو ميشود. فين ميگويد:

اگر شما از مانديشه متخصصين يك انسان به اين مسئله فكر كنيد، خندهدار است. انسانها چيزي كه ياد گرفتهاند را بهراحتي فراموش نميكنند.

يادگيري نحوه يادگيري

موفقيت آلفازيرو در بازيها فقط به خاطر كارآمدي يادگيري تقويتي آن نبود، بلكه همچنين بهعلت استفاده از الگوريتمي بود كه به آن كمك ميكرد تا انتخابهاي خود را محدودتر كند (براساس تكنيكي به نام درخت جستجوي مونت كارلو تعريف شده بود). بهعبارت ديگر، هوش مصنوعي در جهت بهترين حالت يادگيري از محيط خود هدايت ميشد. چوليت فكر ميكند كه مرحلهي مهم بعدي در هوش مصنوعي اين است كه شبكههاي عصبي عميق بتوانند بهجاي استفاده از كدهاي تهيهشده بهوسيلهي انسانها، الگوريتمهاي خود را بنويسند. او استدلال ميكند كه تكميل توانايي تطبيق الگو با تواناييهاي استدلال ميتواند هوش مصنوعي را در برخورد با وروديهايي فراتر از تجربهي آنها بهتر كند.

دانشمندان علوم كامپيوتر، مدتها است «سنتز برنامه» را مورد مطالعه قرار دادهاند كه در آن يك كامپيوتر بهطور خودكار كد توليد ميكند. چوليت فكر ميكند كه تركيب اين زمينه از علم كامپيوتر با يادگيري ماشين بتواند منجر به توسعهي سيستمهايي شود كه به سيستم انديشهي انتزاعي انسان بسيار نزديك باشد. در اين زمينه، كريستن گرامن، دانشمند علوم كامپيوتر مركز پژوهشهاي هوش مصنوعي فيسبوك و دانشگاه تگزاس درحال يادگيري رباتها است تا به بهترين نحو محيطهاي جديد را كشف كنند. اين كار ميتواند شامل انتخاب جهتِ نگاه كردن هنگام ديدن يك صحنهي جديد باشد يا اين موضوع باشد كه براي دستيابي به بهترين درك درمورد شكل يا هدف يك شي، آن شي را چگونه بايد دستكاري كرد. ايده اين است كه كاري كنيم كه هوش مصنوعي بتواند پيشبيني كند كه كدام نما يا زاويه، مفيدترين دادهها را براي يادگيري او مهيا ميكند.

پژوهشگران ميگويند كه آنها در حال تلاش درجهت حل نواقص يادگيري عميق هستند اما در عين حال اعتراف ميكنند كه هنوز مشغول به جستجوي تكنيكهاي جديدي براي كاهش شكنندگي فرايند هستند. سونگ ميگويد تئوري چنداني پشت يادگيري عميق وجود ندارد. او ميگويد:

اگر چيزي كار نكند، درك علت آن دشوار است. كل اين حوزه هنوز بسيار تجربي است و شما فقط بايد مسائل را امتحان كنيد.

اگرچه در حال حاضر، دانشمندان از شكنندگي شبكههاي عصبي عميق و اتكاي آنها روي حجم عظيم دادهها آگاهند، اما اكثر آنها معتقدند كه فعلا اين تكنيك ماندني است و بهگفتهي كلون: «كسي واقعا ايدهاي درمورد چگونگي بهتر شدن آن ندارد.»

هم انديشي ها